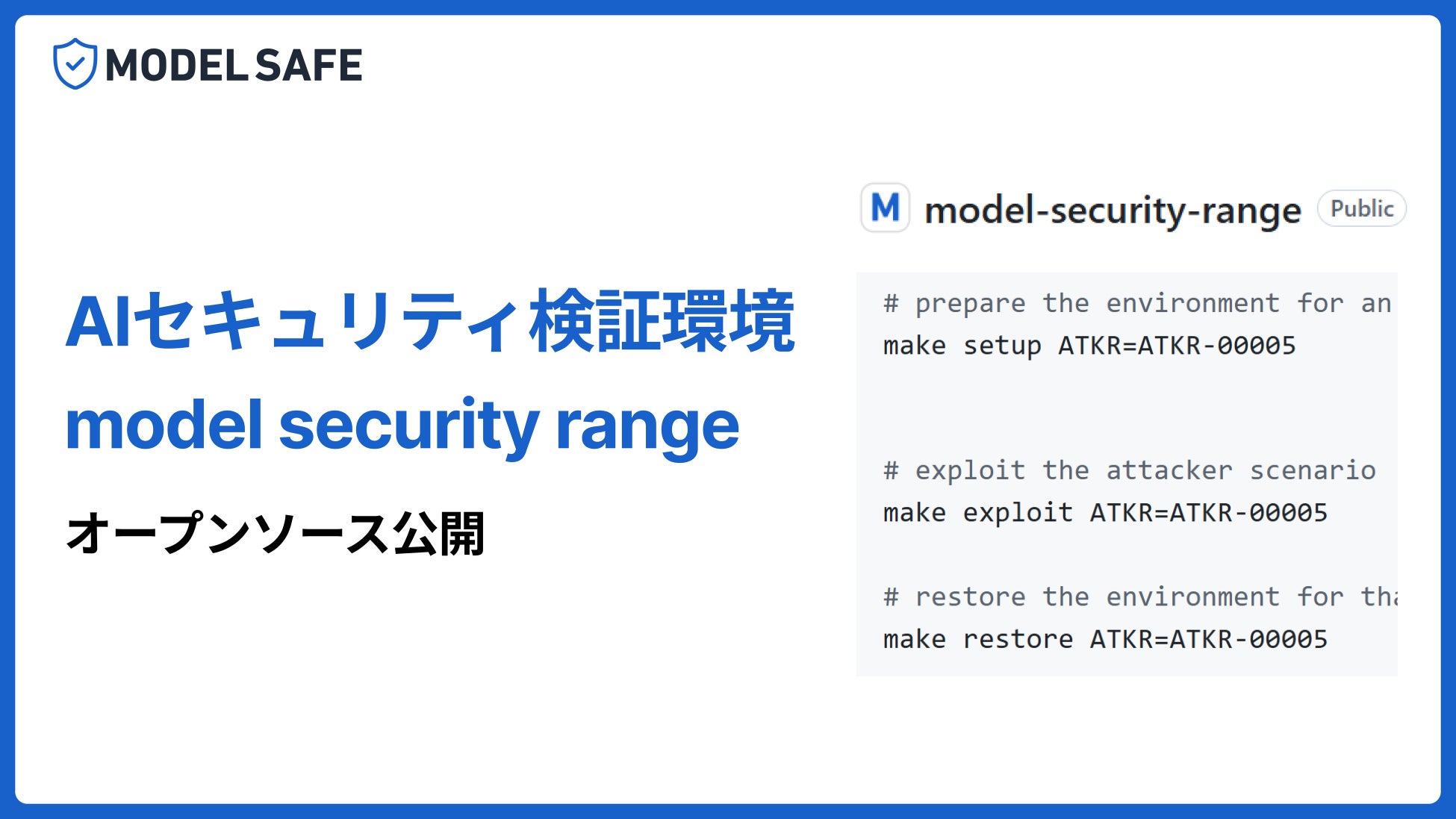

実践的なAIセキュリティ検証環境「Model Security Range」をオープンソース公開

プロンプトインジェクション、ツール権限悪用、データ汚染まで。再現可能な攻撃シナリオで安全なAI運用を実装レベルで学べる検証レンジ

株式会社MONO BRAIN(本社:東京都渋谷区、代表取締役:加藤 真規)は、実践的なAIセキュリティ検証環境「Model Security Range」をオープンソースとして公開したことをお知らせします。

Model Security Rangeとは

「Model Security Range」は、意図的に脆弱性を持たせたAIアプリケーションに対し、攻撃・評価・復旧までを再現可能な手順で実施できるフレームワークです。プロンプトインジェクション、ツール権限悪用、モデル汚染など、実運用で問題化しやすい攻撃クラスを、机上ではなく実装レベルで検証できる構成になっています。

▼ GitHubリポジトリ(無料公開)

https://github.com/monobrain-development/model-security-range

■ 本公開のポイント

・実行可能なAI脆弱性シナリオを、アプリ本体と攻撃コードのセットで公開

・セットアップ、攻撃実行、復旧までを標準化し、再現性の高い検証が可能

・RAG、エージェント、OCR、機械学習モデルなど複数パターンを横断して評価可能

・AI開発者、セキュリティ担当者、研究者が共通の検証基盤として利用可能

■ 公開の背景

生成AIの業務活用が進む一方で、AIシステムに対する脅威は従来のWebセキュリティだけでは捉えきれなくなっています。

例えば、プロンプトインジェクションによる内部情報の漏えい、外部ツール連携時の過剰権限悪用、運用データや学習工程を狙った汚染攻撃など、AI特有の攻撃面は急速に拡大しています。

しかし現場では、 「攻撃を再現できないため、対策の有効性を評価できない」 「担当者ごとに検証方法が異なり、結果を比較できない」 といった課題が残っています。

「Model Security Range」は、こうした実務課題を解消するために設計されました。攻撃手順と評価対象を明示し、誰が実行しても同じ条件で検証できる環境を提供することで、AIセキュリティの実装と運用を前進させます。

■ Model Security Rangeの概要

「Model Security Range」は、以下の考え方で構成されています。

・意図的に脆弱なアプリケーションを用意し、攻撃成立条件を明確化

・攻撃シナリオごとにセットアップ、実行、復旧を分離して管理

・再現性、透明性、計測可能性を重視した検証ワークフローを提供

・単発のデモではなく、継続的なハードニング学習に活用可能

■ 現在公開中の主な検証シナリオ

1. Prompt Injection(RAG Chatbot / Gemma 3 4B)

・RAG文脈への注入を通じた機密情報漏えい

・埋め込み済みナレッジファイルの開示誘導

・システムプロンプト漏えい

2. Tool Misuse(Agent with DB / Gemma 3 4B)

・過剰権限ツールの悪用によるデータ流出

・命令乗っ取りによる破壊的SQL実行

3. Indirect Prompt Injection(AI OCR / Gemma 3 4B)

・ファイルアップロード経由での間接的な脱獄誘導

4. Supply Chain Vulnerabilities(Creditworthiness Assessment / ML)

・汚染済み学習成果物によるターゲット型バックドア挙動

5. Data Poisoning(Spam Email Classification / ML)

・フィードバックループ悪用による分類器性能の劣化

■ 利用イメージ

・社内AIアプリのリリース前セキュリティ検証

・レッドチーム/ブルーチーム合同の演習

・開発者教育、ハンズオン、研究用途での攻撃再現

・対策実装後のリグレッション確認

■ こんな方におすすめ

・生成AIを活用したプロダクトを開発・運用しているエンジニア

・AIセキュリティ評価の標準手順を整備したいセキュリティ担当者

・AIリスクの実証研究を進める研究者、学生

・AIガバナンスや監査対応を担う実務担当者

■ ご利用にあたって

本プロジェクトは教育・検証目的で公開しています。公開シナリオには意図的に脆弱な実装が含まれます。

本番環境や許可のない対象に対する攻撃行為への利用は行わないでください。適用法令、組織ポリシー、契約条件を遵守し、管理された環境でご利用ください。

■ AIセキュリティプラットフォーム「MODEL SAFE」について

「MODEL SAFE」は、AIの設計・開発・運用を一体で管理し、AIを“あとから説明できる状態”で運用することを支援するAIセキュリティプラットフォームです。

AIサプライチェーンの可視化、変更管理、ランタイム監視・制御を通じて、技術的安全性・運用統制・規制対応を統合的に支援します。

ガバナンス体制の整備やリスク可視化に取り組まれている企業様は、ぜひお問い合わせください。

▼ お問い合わせ

▼ MODEL SAFE サービス紹介

すべての画像