SLV v0.13 リリース ― CLI を覚える時代は終わり、Solana 開発は AI エージェントとの対話に

Solana 開発・運用の主要インターフェースを CLI 中心から AI エージェントとの対話中心へ移す転換点

ELSOUL LABO B.V.(本社:オランダ・アムステルダム、代表取締役 CEO:川崎文武)および Validators DAO が開発・運用するオープンソース Solana 開発ツール SLV は、v0.13 をリリースしました。

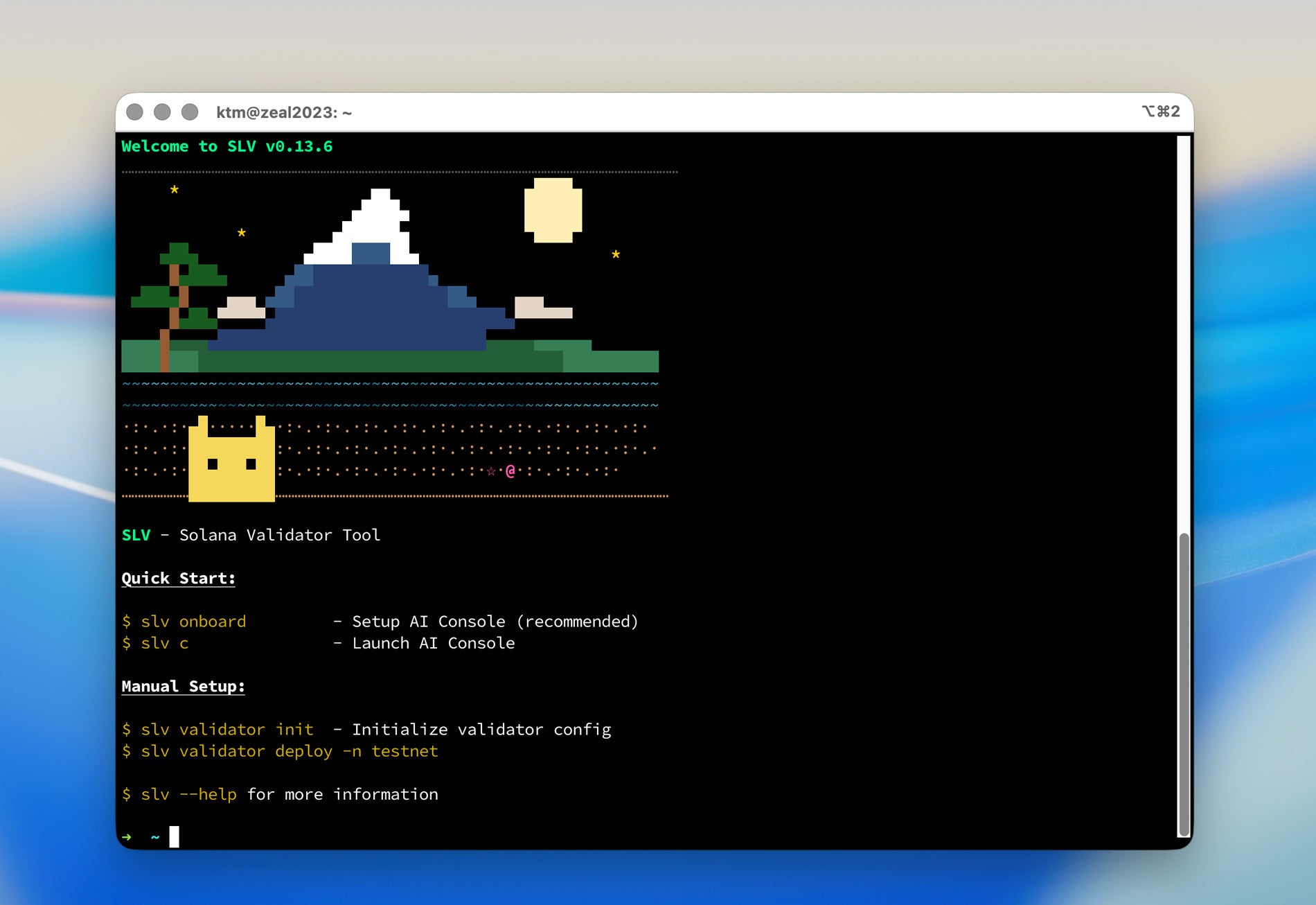

インストール後、`slv onboard` で環境をセットアップし、`slv c` で AI Console を起動する。これだけで、Solana バリデータ・RPC・アプリ開発のすべてを自然言語で始められる環境が整います。MCP の設定ファイルを手動で書く必要も、エンドポイントを調べて登録する必要もありません。

本リリースは、Solana 開発・運用の主要インターフェースを CLI 中心から AI エージェントとの対話中心へ移す転換点です。

SLV 公式サイト: https://slv.dev/ja

Getting Started: https://slv.dev/ja/doc/general/getting-started/

SLV — The AI Agent Kit for Solana Devs

SLV は、Solana 開発者のための AI Agent Kit です。バリデータ、RPC、Geyser gRPC、アプリ開発まで、Solana 開発に必要な運用基盤を一貫して提供するオープンソースツールであり、すべてのメソッドが MCP(Model Context Protocol)に対応しています。

v0.13 では、この MCP 対応基盤へのアクセスを極限まで簡素化しました。オンボーディングの対話ウィザードを完了するだけで、SLV のすべてのメソッドが AI エージェントから実行可能になります。MCP の設定、鍵へのアクセス、バージョン追従 — これまで個別に対処していた運用課題が、一つのインターフェースに収束します。

なぜこのリリースが転換点なのか

MCP の設定は、本来面倒である

AI エージェントを Solana インフラの運用に活用するには、MCP サーバーの設定、エンドポイントの登録、認証情報の接続、対応ツールの選定など、事前に多くの準備が必要です。これらの手順は技術に精通した開発者であっても煩雑であり、「AI エージェントを試してみたい」と思った段階でつまずく原因になっていました。

SLV v0.13 では、この障壁をすべて取り除きました。`slv onboard` の対話ウィザードが、AI プロバイダーの接続、モデルの選択、利用するスキルの設定、API キーの登録までを一括で案内します。MCP の設定ファイルを手で書く必要はなく、エンドポイントを調べて登録する必要もありません。

鍵の管理もセキュアに統合

Solana バリデータ運用では、アイデンティティキー、Vote アカウントキー、Authority キーなど、複数の鍵を正確に取り扱う必要があります。SLV の AI エージェントは、ローカル環境に保管されたこれらの鍵にセキュアにアクセスできる設計です。鍵のパスを毎回指定したり、外部に送信したりする必要はありません。

セキュリティを犠牲にすることなく、運用の認知負荷を構造的に下げる。これが SLV の設計方針です。

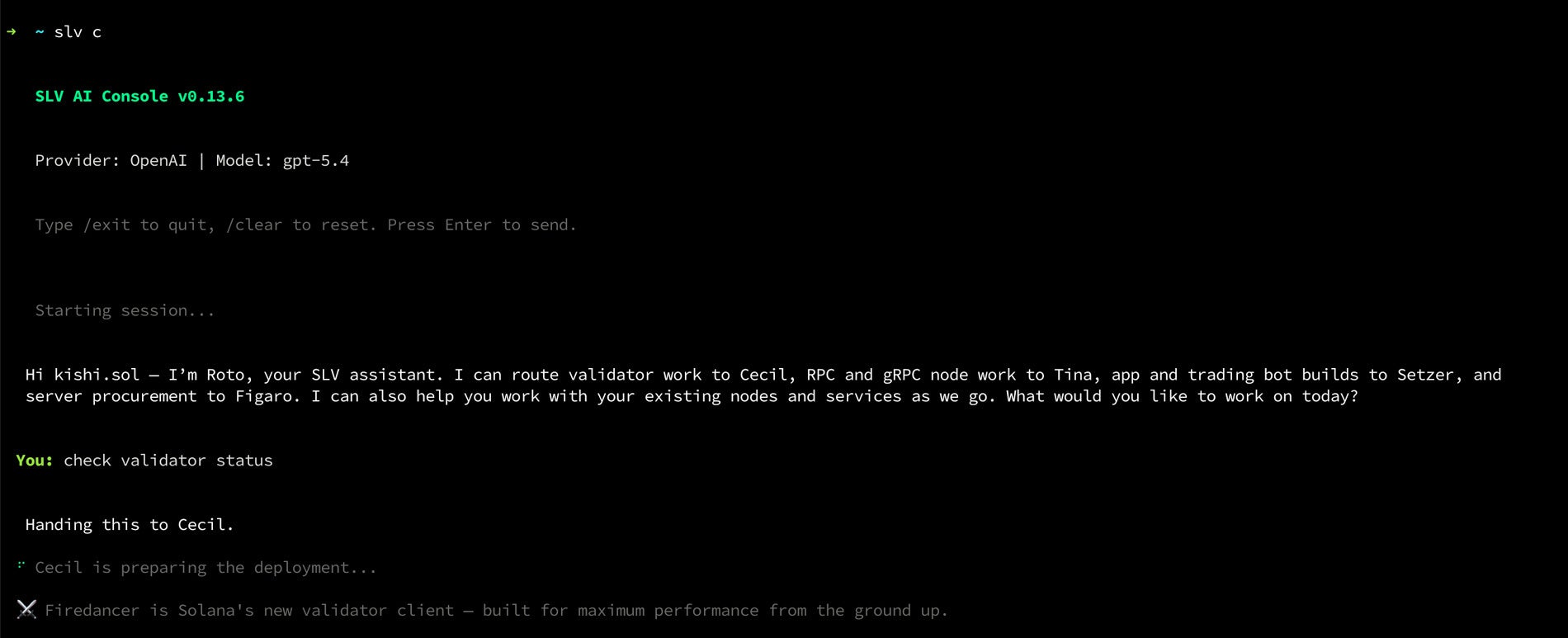

AI Console — 話しかけるだけで、運用が前に進む

`slv c` で起動する AI Console は、SLV の中核となるインターフェースです。

バリデータのデプロイ、アップグレード、ダウングレード、アイデンティティの切り替え、RPC ノードの構築、Geyser gRPC の設定、アプリ開発のスキャフォールド — これらを、自然言語で AI エージェントに依頼するだけで実行できます。

CLI のフラグを覚える必要はありません。ドキュメントを検索する必要もありません。やりたいことを伝えると、AI エージェントが MCP 対応の SLV ツールセットを直接操作し、適切な手順を選択・実行します。内容に応じて専門エージェントへ自動でルーティングされ、バリデータ運用、RPC と Geyser の構成、アプリ開発、サーバー調達まで、それぞれの分野に特化したエージェントが対応します。

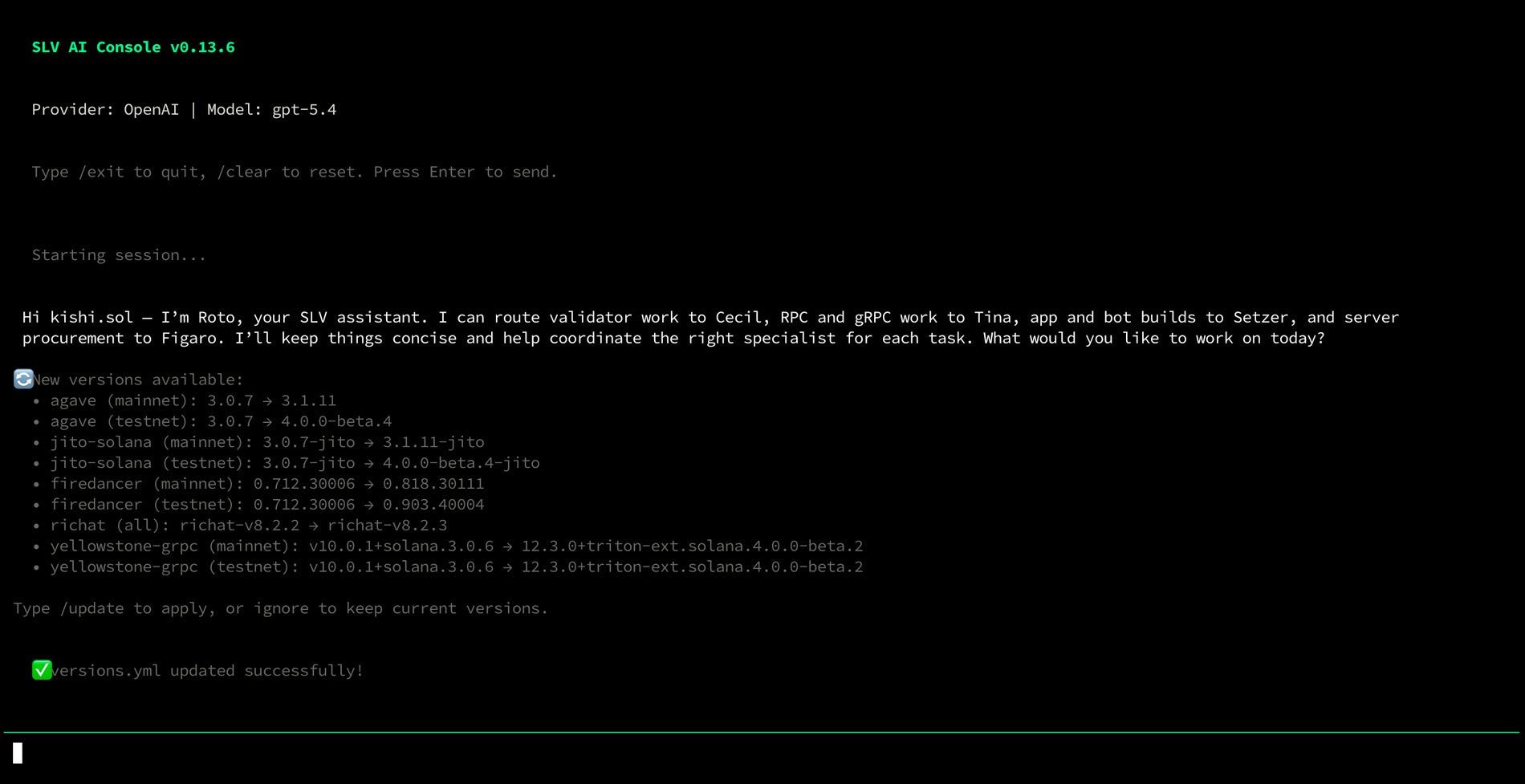

起動するだけでアップデートを自動チェック

AI Console は起動時に、agave、jito-solana、firedancer、yellowstone-grpc などの最新バージョンを自動で取得し、アップデート候補を一覧で表示します。アップデートを適用したい場合は `/update` と入力するだけです。バージョン情報の確認も、適用も、AI エージェントがすべて処理します。

Solana では現在、v3 系へのアップグレードに伴い頻繁なバージョン変更と切り戻しが求められています。毎回の手順確認と実行にかかる運用負荷を、AI エージェントが構造的に引き受けます。

認知負荷という見過ごされてきたコスト

バリデータ運用において、ダウンタイムは収益に直接影響します。正確に状況を把握し、適切なコマンドを適切に入力する — この作業は一見単純に見えて、実際には脳の消耗が非常に大きい作業です。

通常のアプリケーション開発とは異なり、バリデータ運用におけるワンコマンドの重みは格段に大きくなります。一つの入力ミス、一つの見落としが、ネットワーク品質の低下やステーカーへの影響に直結します。この認知負荷は、バリデータ運用の隠れたコストとして長く見過ごされてきました。

AI エージェントによる自然言語操作は、コマンドの正確な構文を思い出す負荷、手順書を照合する負荷、バージョン間の差異を記憶しておく負荷を構造的に取り除きます。これは単なる UX の改善ではありません。認知負荷が下がることで判断ミスやオペレーションエラーの発生確率が下がり、結果としてダウンタイムの低減とネットワーク品質の向上につながります。

私たち自身の運用においても、自然言語で意図を伝える運用フローを経験すると、コマンドの構文や手順を逐一思い出しながら進める従来のフローには戻りづらくなっています。認知負荷の差が、そのまま運用品質の差になるからです。運用者がより本質的な判断 — ネットワーク戦略、パフォーマンス改善、ステーク拡大 — に集中できる環境を、AI エージェントが支えています。

Solana バリデータへの参入障壁を構造的に下げる

SLV v0.13 が実現したのは、単なる操作の簡素化ではありません。Solana ネットワークへの参入障壁そのものを構造的に引き下げたことです。

これまで Solana バリデータの運用には、Linux の深い知識、CLI の習熟、Solana 固有の設定ファイルの理解、バージョン管理の判断力が求められていました。これらの前提が、技術的な専門性を持たないビジネスパーソンや組織にとって参入の壁となっていました。

SLV v0.13 では、必要な知識へのアクセスと実行導線が AI エージェントによって大幅に改善されます。運用に必要な知識は AI エージェントが MCP 経由で参照し、適切な手順を自動的に構成・実行します。技術的な専門性がなくても、バリデータの立ち上げから日常運用までの導線が開かれます。AI エージェントが下げるのは参入障壁と日常運用の認知負荷であり、運用主体としての意思決定は従来と同様に運用者に委ねられます。

Solana ネットワークの品質は、バリデータの数と多様性に直接依存します。参入障壁が下がり、より多くの主体がバリデータとして参加できるようになることは、ネットワーク全体の分散性と回復力を高めることを意味します。

CLI も健在 — プロジェクトの成長に合わせた選択肢

AI エージェントとの対話が SLV の主要インターフェースになりつつありますが、開発の骨格を支える CLI ツールは引き続き健在です。

SLV の CLI は、実際の運用に役立つ機能を使いやすい形で提供しています。プロジェクトの成長により複数台のサーバーを管理する必要が出てきた場合には、Ansible を活用した再現性の高い環境構築が可能です。インベントリファイルによるマルチノード管理、Playbook による一括デプロイ・アップデートなど、大規模運用に耐える設計です。

SLV の前身は、Epics DAO が開発した solv です。ノードに直接インストールしてシングルノードで手軽に運用するスタイルに根強い人気があることを理解しています。この取り回しのしやすさを重視するユーザーの方にも合流いただけるよう、ローカル実行に適した利用法の整備も進めています。

AI エージェント、CLI 直接実行、Ansible によるマルチノード管理 — 規模や運用スタイルに応じて、最適な手段を選べる構成です。

ChatGPT と Claude に対応

SLV v0.13 は、AI プロバイダーとして ChatGPT(OpenAI)と Claude(Anthropic)に正式対応しています。`slv onboard` のウィザードの中で、利用する AI とモデルを選択するだけで接続が完了します。

どちらの AI を普段使っているかに関わらず、SLV の AI エージェント環境をそのまま利用できます。

分散配置の時代へ — ASN 集中度が問われる Solana ネットワーク

Solana Foundation は、デリゲーションプログラムの要件として ASN およびデータセンターの集中度制限を強化しています。特定の ASN やデータセンターにバリデータが集中しすぎた場合、Foundation からのステークデリゲーションが制限される仕組みです。

この方針は、Solana ネットワークの分散性と耐障害性を高めるための構造的な設計です。しかし同時に、バリデータ運用者にとっては「ノードを立てられるかどうか」だけでなく、「どの ASN に、どのデータセンターに、どう配置するか」までを考慮した運用設計が求められるようになることを意味します。

ELSOUL LABO B.V. は、RIPE NCC より自社 ASN(AS200261)の付与を受け、Solana 特化のトップティア新データセンターの開設を進めています。最新世代の AMD EPYC 第 5 世代、AMD Threadripper PRO 第 5 世代(9975WX 等)、NVMe 第 5 世代で統一されたハードウェア構成に加え、自社 ASN による最適なネットワーク経路設計を実現します。来月のオープンを予定しています。

これは単なるデータセンター計画ではありません。ASN の集中度制限が強化される流れの中で、独立した ASN を持ち、自ら配置戦略を設計できることは、バリデータ運用の持続可能性に直結します。そして、この分散配置を現実的に運用し続けるためには、配置・構成・アップデート・移行を自動化できる基盤が不可欠です。SLV が提供する運用オーケストレーションは、まさにこの課題に対する回答です。

ノードを立てることから、どこに・どう配置し・どう継続運用するかまで。SLV と ERPC は、これからの Solana 運用に求められる設計の全域をカバーしていきます。

オープンソースで提供

SLV は、引き続きオープンソースで提供されます。バリデータ運用、RPC 構築、アプリ開発 — Solana の運用に関わるすべての方が、SLV の AI エージェント環境を無料で利用できます。

インストールから自然言語での運用開始まで、必要な時間はわずか数分です。

SLV GitHub: https://github.com/validatorsDAO/slv

ERPC — SLV と連携する Solana インフラプラットフォーム

SLV で構築した環境を ERPC プラットフォーム上にデプロイすることで、最速の通信条件、Solana に特化したチューニング、プラットフォーム内サービスとのゼロ距離通信が最初から手に入ります。

Solana RPC、Solana Geyser gRPC、Solana Shredstream、ベアメタルサーバー、VPS、Global Storage — すべてが同一プラットフォーム内に統合されています。SLV の AI エージェントと ERPC の組み合わせが、Solana 開発における最速かつ最も運用しやすい基盤を提供します。

ERPC 公式サイト: https://erpc.global/ja

5 年連続 WBSO 承認

ELSOUL LABO は、オランダ政府の研究開発支援制度 WBSO において 2022 年以降 5 年連続で承認を受けています。2026 年に承認された研究開発プロジェクトには「バリデータ配置および運用オーケストレーションの自動化に関する研究開発」が含まれており、SLV v0.13 の AI エージェント統合は、この研究テーマが実装として結実したものです。

研究の仮説は実装として形になり、運用の制約下で検証され、そこで得られた課題が次の研究に取り込まれる。SLV は、この循環の中で進化を続けています。

お問い合わせ

SLV および ERPC に関するお問い合わせは、Validators DAO 公式 Discord にてサポートチケットを作成ください。

Validators DAO 公式 Discord: https://discord.gg/C7ZQSrCkYR

リンク一覧

-

SLV 公式サイト: https://slv.dev/ja

-

SLV Getting Started: https://slv.dev/ja/doc/general/getting-started/

-

SLV GitHub: https://github.com/validatorsDAO/slv

-

ERPC 公式サイト: https://erpc.global/ja

-

Validators DAO 公式 Discord: https://discord.gg/C7ZQSrCkYR

すべての画像