SLV、Solana バリデータの PoH を高速化する SHA-256 最適化パッチ(通称 kagren パッチ)に対応

PoH speed check で 10〜20% の性能向上、Epics DAO バリデータの運用知見を AI エージェント経由で全 SLV ユーザーへ

ELSOUL LABO B.V.(本社:オランダ・アムステルダム、代表取締役 CEO:川崎文武)および Validators DAO が開発・運用するオープンソース Solana 開発ツール SLV は、Solana バリデータの PoH(Proof of History)SHA-256 計算を高速化する最適化パッチ(通称 kagren パッチ)への対応をリリースいたしました。

Epics DAO バリデータでの実運用検証を経て、Solana バリデータおよび Solana RPC ノードの両方を対象に、SLV ユーザーであれば AI エージェントとの対話だけで適用できる形で取り込みました。

SHA-NI 命令を備える AMD Zen3 以降の CPU 上で、起動時の PoH speed check において 10〜20% の性能向上が見込まれます。この性能向上は、Solana バリデータがリーダースロット中に行う処理の余裕に直結します。

SLV 公式サイト: https://slv.dev/ja

SLV GitHub: https://github.com/validatorsDAO/slv

kagren パッチとは — Solana バリデータの最ホットパスをピンポイントで最適化する取り組み

Solana のコンセンサスは、PoH(Proof of History)と呼ばれる連続する SHA-256 ハッシュチェーンを基盤としています。前回のハッシュ(32 バイト)を入力として次のハッシュを生成する処理が、1 スロット(約 400 ミリ秒)の間に数十万回繰り返されます。Solana バリデータのコードパスの中で、この PoH の SHA-256 計算は最も高頻度に実行される処理であり、CPU 時間の支配的な消費要素です。

通称「kagren パッチ」は、この最ホットパスをピンポイントで最適化する取り組みです。オリジナル作者の kagren 氏が、solana-sdk の sha256-hasher を fork し、32 バイト・1 ブロックという PoH の入力条件に特化した SHA-NI 実装を提供しています。

このパッチは Creative Commons CC0 1.0 Universal License で公開されており、誰もが自由に利用・改変・再配布できます。Solana エコシステム全体への貢献として公開された kagren 氏の取り組みに、心より敬意を表します。

solana-sha256-hasher-optimized(kagren): https://github.com/kagren/solana-sha256-hasher-optimized

SHA-NI 命令と 32 バイト・1 ブロックの決定論的最適化

SHA-256 は 64 バイト(512 ビット)のブロック単位で処理を行うアルゴリズムです。32 バイトの入力を処理する場合、残りの 32 バイトは仕様で定められたパディング — 先頭の 0x80 バイト、ゼロ埋め、末尾の入力長を示すビット列 — で埋められます。

ここで注目すべきは、PoH のように常に 32 バイト・1 ブロックでハッシュを計算し続けるケースでは、このパディング部分が完全に決定論的であるという点です。kagren パッチは、この決定論的な部分を SHA-NI 命令を使った計算経路上で事前に展開し、汎用実装に含まれていた分岐・ループ・ロード処理を取り除いています。これにより、32 バイト・1 ブロックという PoH の入力条件において、SHA-NI のスループットを最大限に引き出します。

入力サイズが 32 バイト以外の場合、あるいは複数ブロックを跨ぐ場合は、従来の汎用実装が引き続き使用されます。オンチェーンの SHA-256 計算(SBF 上で実行されるプログラム内のハッシュ計算)も一切変更されません。最適化の対象は、PoH のように 32 バイト・1 ブロックを連続して計算する用途に限定されており、それ以外の経路には影響を与えない設計です。

PoH speed check で 10〜20% の性能向上 — リーダースロット中の処理余裕に直結する

AMD Zen3 以降の CPU 上で、Solana バリデータの起動時に実行される PoH speed check の値が、本パッチの適用前後で 10〜20% 向上することがオリジナル作者の検証で報告されています。Epics DAO バリデータでの実運用検証においても、同水準の性能向上を確認できました。

この性能向上が意味するのは、単なるベンチマーク数値の改善ではありません。PoH の計算余裕は、Solana バリデータがリーダースロット中に行う処理の余裕に直結します。トランザクションの取り込み、Compute Units の積み上げ、ブロック生成 — リーダースロット中の限られた時間の中で、PoH 計算に消費される CPU 時間が削減されることで、それ以外の処理に振り向けられる余裕が増えます。

vote レイテンシ、スキップ率、ブロックあたりの Compute Units といった主要な性能指標を押し上げるための、地味ながら確実な改善の一つです。

コンセンサスへの影響なし — 完全互換のフォールバック設計

kagren パッチが適用された SHA-256 計算は、標準実装と完全に同一の結果を返します。32 バイト・1 ブロックの入力に対しては最適化された経路、それ以外には標準実装と、実行パスが入力条件で分岐する設計です。オンチェーンの SHA-256 計算は一切変更されません。

ハッシュ結果が他のバリデータと食い違うことによってフォークに乗ってしまうといったコンセンサス上のリスクは、構造的に存在しません。SLV では、パッチ適用済みバイナリのデプロイ前に検証を実施し、標準実装との結果一致を確認したうえで切り替えを行います。

対象 CPU と前提条件

本パッチが効果を発揮するのは、SHA-NI 命令セットを備えた CPU 上に限られます。具体的には、AMD Zen3 以降のアーキテクチャ — EPYC 7003 / 9004 / 9005 シリーズ、Ryzen 5000 シリーズ以降、Threadripper 5000 / 7000 シリーズなどが対象です。

Epics DAO バリデータの運用および ERPC プラットフォームで採用している主要構成の多くがこの条件を満たしており、ERPC の Solana RPC ノードや SLV Metal シリーズの大半で本パッチの恩恵を受けられます。SHA-NI 命令を持たない古い世代の CPU 上では、SLV は本パッチの適用をスキップし、標準実装での運用を継続します。

Epics DAO バリデータでの実運用検証 — 世界 3 位を支える積み重ねの一つに

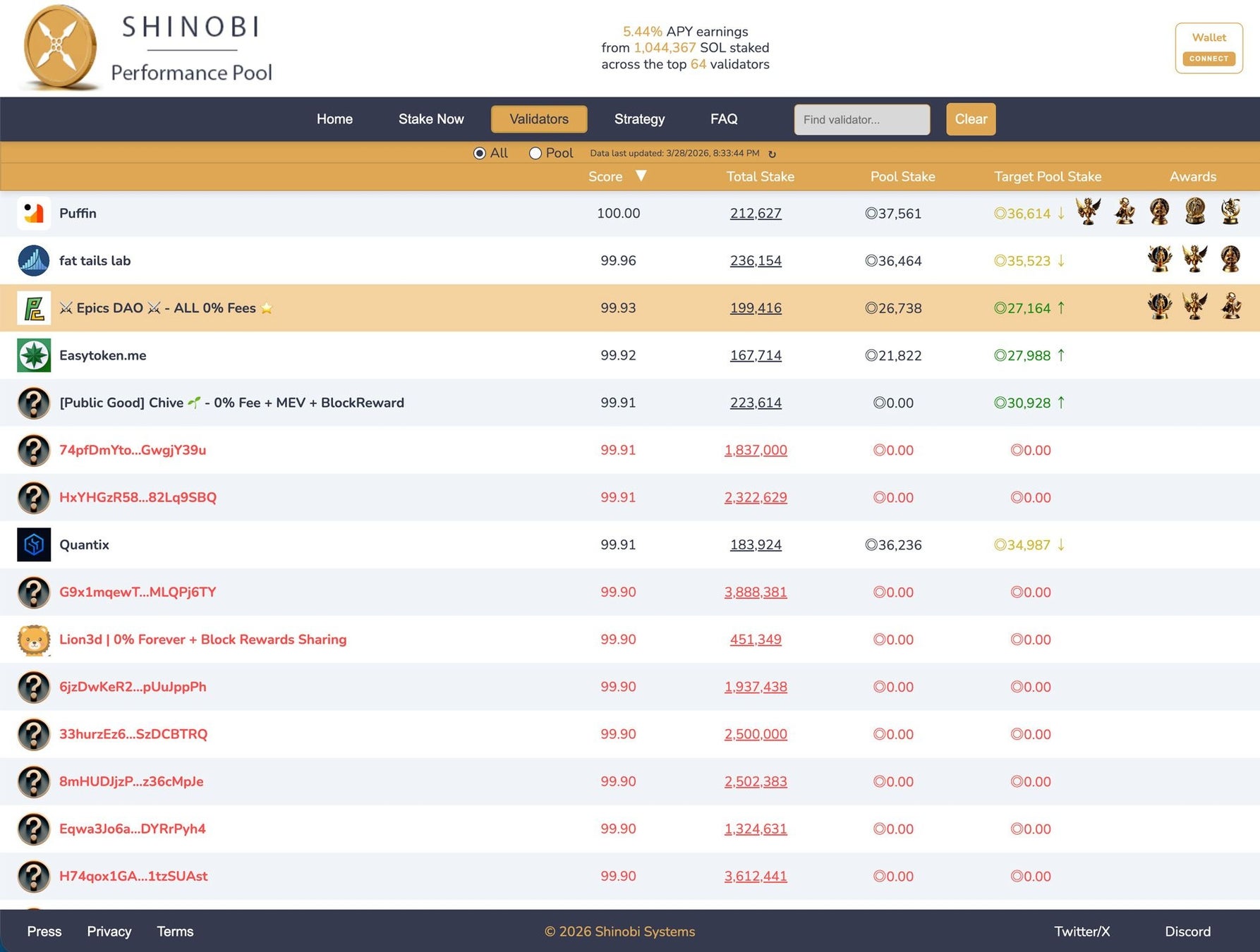

ERPC の SWQoS エンドポイントおよび Epic Shreds の配信元として運用している Epics DAO バリデータは、全 Solana バリデータの中で Shinobi Performance Pool 世界総合 3 位(スコア 99.93)に到達しています。この結果は、ハードウェア選定、カーネルパラメータの最適化、ネットワークスタックのチューニング、IRQ アフィニティの調整、DoubleZero の導入 — 複数の改善の積み重ねによるものです。

kagren パッチの取り込みは、この積み重ねの中の新たな一つです。Epics DAO バリデータでの実運用検証を経て、本番環境での効果と安定性を確認したうえで、SLV のスキルとして取り込みました。世界トップクラスのバリデータ運用で実証された改善手法を、SLV ユーザーであれば誰でも再現できる形で提供します。

Validators DAO は、Solana ネットワーク全体の処理品質と耐障害性を高めるために存在しています。一つ一つのバリデータの性能向上は、Solana チェーン全体の処理速度の押し上げに直結します。kagren 氏が CC0 で公開した最適化が、Epics DAO バリデータでの検証を経て、SLV を通じて世界中のバリデータオペレーターに届く — この知見の還元こそが、私たちの存在意義です。

SLV による Validator / RPC 両対応 — クライアント自動判別とリモートビルド・デプロイ

SLV の今回の対応では、Solana バリデータと Solana RPC ノードの両方が本パッチの適用対象となります。

SLV は、対象ノードのクライアント種別(Agave、Jito-Agave)を自動的に判別し、適切な Solana ソースツリーをリモートビルド環境にクローンします。kagren パッチのリポジトリも自動的に取得し、PoH のハッシュロジックに対するパッチ適用、ターゲット CPU 向け最適化フラグでのリビルド、既存バイナリのバックアップ、パッチ済みバイナリのデプロイまで、一連のプロセスを SLV が完結させます。

Solana のソースバージョンは明示的に指定することも、SLV が管理しているバージョン情報に基づいて自動解決させることもできます。複数ノードに対する一括適用にも対応しており、運用中のフリート全体に対して順次適用していくユースケースをカバーします。

なお、パッチ適用済みバイナリのデプロイ後、Solana バリデータ・RPC プロセスの再起動はユーザー側で別途実施します。SLV はバイナリの差し替えまでを担い、再起動のタイミングは運用方針に委ねる設計としています。SLV AI エージェントを使っている場合は、再起動も AI エージェントに任せることができます。

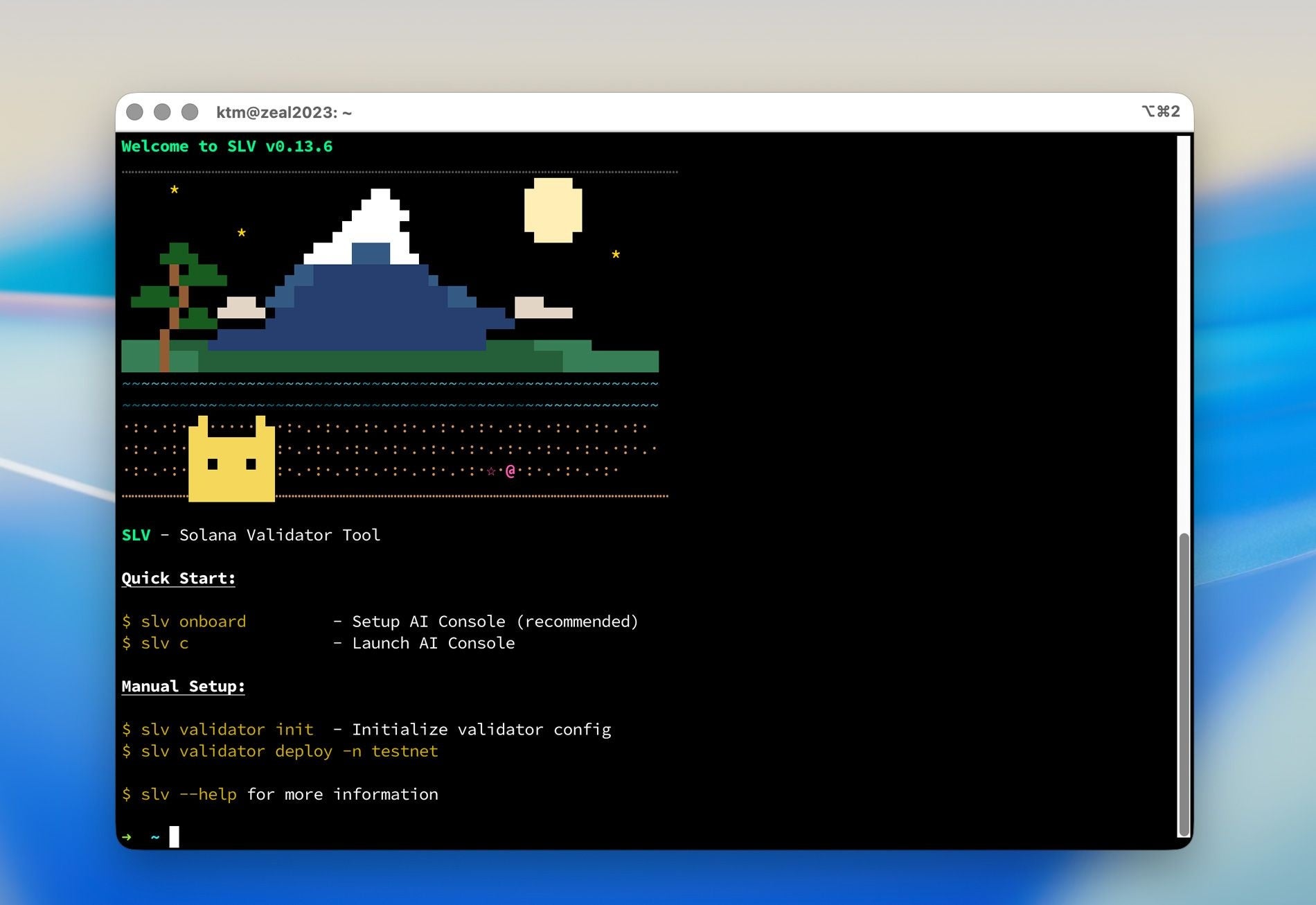

AI エージェントとの組み合わせ — 自然言語の対話だけで完結

SLV の他の機能と同様に、kagren パッチの適用も MCP(Model Context Protocol)に対応しています。AI Console を起動し、AI エージェントに「このバリデータに SHA-256 最適化パッチを適用して」と話しかけるだけで、対象ノードの判別、ビルド、デプロイまでを AI エージェントが手順を選択して実行します。

CLI による実行にも対応しており、スクリプト化された自動化フローに組み込むこともできます。AI エージェントの使用有無にかかわらず、同じ MCP 基盤の上で同じ動作が再現されます。

これまで、Solana バリデータへのカスタムパッチの適用には、ソースコードのクローン、ビルド環境の構築、依存関係の解決、パッチの取り込み、最適化フラグの調整、バイナリの差し替え — これらの一連の作業を、運用者が自分でこなす必要がありました。SLV は、このプロセス全体を AI エージェントが代行できる形で抽象化しています。

性能改善のために導入したい技術が、運用の煩雑さによって導入を躊躇われることがあってはならない — SLV の DoubleZero 対応で打ち出した方針を、kagren パッチでも継続しています。

ローカルモードにも対応 — 手元の 1 台でも、フリート全体でも

SLV はリモート管理に加えてローカルモードにも対応しており、ssh でログインしたノード上で SLV を直接動作させることができます。kagren パッチの適用もローカルモードでそのまま動作するため、運用中の単一ノードに対して直接パッチを適用することも、Ansible ベースのリモート管理構成からフリート全体に一括で適用していくことも、同じ SLV 環境で完結できます。

solv からの移行を進めているユーザーにとっても、ローカルモードでの kagren パッチ適用は導入しやすい選択肢です。1 台から始めて必要に応じてリモート管理にスケールするという SLV の設計方針が、性能チューニングの導入経路にも一貫しています。

Solana ネットワーク全体への貢献

Solana は分散コンピューティングネットワークです。その性能は、世界中に分散するバリデータ一つ一つの性能の総和によって決まります。

個々のバリデータが PoH 計算で獲得する 10〜20% の余裕は、ネットワーク全体で見れば、リーダースロット時の処理余裕、vote の追従精度、ブロック生成の安定性として積み上がります。kagren 氏が CC0 で公開した最適化を、SLV のような運用基盤を通じてより多くのバリデータに届けることは、Solana ネットワーク全体の性能と耐障害性に対する貢献です。

SLV は、こうした実運用に直結する改善を、AI エージェントとの対話だけで適用できる環境として提供し続けてまいります。バリデータ運用の認知負荷を構造的に下げ、性能改善に必要な作業のハードルを下げることで、より多くの運用者がより高い品質でバリデータを運用できる環境を整えていきます。

オープンソースとして提供 — 知見の還元を続ける

SLV 本体は、引き続きオープンソースで提供されます。kagren パッチの取り込みを含むすべての機能は、SLV の GitHub リポジトリから自由に取得・利用できます。

ERPC の実運用と研究開発から得られた知見は、SLV のスキルとツールを通じてすべてオープンソースとして公開されています。Epics DAO バリデータが世界 3 位に到達するまでに積み重ねてきた最適化手法、チューニングパラメータ、運用ノウハウ — これらが SLV のスキルとして AI エージェントに集約され、世界中のバリデータオペレーターが同じ品質で再現できる形になっています。

SLV 公式サイト: https://slv.dev/ja

SLV GitHub: https://github.com/validatorsDAO/slv

SLV AI トークンで今すぐ試せる

kagren パッチの適用も、SLV の AI エージェント機能の一部としてご利用いただけます。SLV AI トークンを利用することで、AI エージェントとの自然言語対話で適用作業を完結できます。

リリース記念として、5€ の Authorization を行うことで 100,000 トークンを無料で配布しています。kagren パッチの適用を AI エージェントとの対話で体験するのに十分なボリュームです。ChatGPT および Claude の API トークンを利用した接続にも対応しており、お客様自身の API キーで SLV AI を動作させることも可能です。

ERPC SLV AI Plans: https://erpc.global/ja/price/

ERPC プラットフォームとの組み合わせ

ERPC プラットフォーム上で運用されている Solana バリデータおよび Solana RPC ノードのすべては、AMD Zen4 以降の CPU を搭載しており、kagren パッチの恩恵を受けられる構成です。SLV で構築した環境を ERPC プラットフォーム上にデプロイすることで、プラットフォーム内の高速スナップショットダウンロード、Solana バリデータとのゼロ距離通信、Solana に特化したチューニング済みの構成、そして kagren パッチによる PoH 高速化のすべてを最初から手にできます。

ERPC は、Solana RPC、Solana Geyser gRPC、Solana Shredstream(Epic Shreds)、ベアメタルサーバー、ハイパフォーマンス VPS、ERPC Global Storage を同一プラットフォーム内に統合し、すべてが内部ネットワーク経路で接続されたゼロ距離設計を採用しています。DoubleZero の専用ファイバーネットワークも全リージョンに統合されており、特にアジアリージョン(東京・シンガポール)で P99 約 200ms のレイテンシ短縮を達成しています。

ERPC 公式サイト: https://erpc.global/ja

5 年連続 WBSO 承認 — AS200261 Solana 特化データセンター

ELSOUL LABO は、オランダ政府の研究開発支援制度 WBSO において 2022 年以降 5 年連続で承認を受けています。Solana RPC インフラ、バリデータ運用オーケストレーション、AI エージェントによる Solana 運用環境の構築に関する継続的な研究開発の成果が、SLV のツール群と AI エージェントに直接実装されています。

この研究開発の集大成として、RIPE NCC より付与を受けた自社 ASN(AS200261)による Solana 特化データセンターの開設を進めています。最新世代の AMD EPYC 第 5 世代、AMD Threadripper PRO 第 5 世代(9975WX 等)、NVMe 第 5 世代で統一されたハードウェア構成に加え、自社 ASN による最適なネットワーク経路設計を実現する、既存のプレミアムデータセンターを超える最高品質のインフラです。今月のオープンを予定しており、SLV AI エージェントが構築する環境の基盤としてさらなる高速化を支えます。

kagren 氏への謝辞

今回の SLV への取り込みは、kagren 氏が公開された solana-sha256-hasher-optimized リポジトリの成果なくしては実現しませんでした。Solana エコシステムへの貢献として CC0 で公開された取り組みに、改めて深い敬意と感謝を表します。

オープンソースで公開された改善が、別のオープンソースツール(SLV)を通じて世界中のバリデータオペレーターに届く — このような知見の循環が、Solana エコシステム全体を強くしていきます。私たちも、ERPC プラットフォームと Epics DAO バリデータの運用で得られた知見を、SLV を通じてオープンソースで還元し続けてまいります。

solana-sha256-hasher-optimized(kagren): https://github.com/kagren/solana-sha256-hasher-optimized

お問い合わせ

SLV および ERPC に関するお問い合わせは、Validators DAO 公式 Discord にてサポートチケットを作成ください。

Validators DAO 公式 Discord: https://discord.gg/C7ZQSrCkYR

すべての画像