楽天、「GENIACプロジェクト」の一環として国内最大規模の新たな高性能AIモデル「Rakuten AI 3.0」を開発

- 日本語ベンチマークにおいてトップスコアを達成、「楽天エコシステム」のサービス活用では最大90%のコスト削減を実現 -

楽天グループ株式会社(以下「楽天」)は、経済産業省および国立研究開発法人新エネルギー・産業技術総合開発機構(以下「NEDO」)が推進する日本の生成AIの開発力強化を目的としたプロジェクト「GENIAC(Generative AI Accelerator Challenge)プロジェクト」(以下「GENIAC」)の一環として開発した新たなAIモデル「Rakuten AI 3.0」(以下「本モデル」)を本日発表しました。

本モデルは、Mixture of Experts(以下「MoE」)アーキテクチャ(注1)を採用した日本語大規模言語モデル(以下「LLM」)で、生成AI APIを統合した開発用プラットフォーム「Rakuten AIゲートウェイ」(注2)の生成AI API群に加わり、「Rakuten AI」(注3)エージェントプラットフォームを通じて、楽天のサービスに順次導入される予定です。また、来春を目途に、オープンウェイトモデルとしての公開も計画しています。

日本語に特化したLLMとして、楽天がこれまでに開発したAIモデルや他のLLMの中でも最大規模(注4)となる約7,000億個のパラメータを持つMoE LLMである本モデルは、オープンソースコミュニティ上の最良なモデルを基に、楽天独自の高品質なバイリンガルデータ、技術力および研究成果によって開発しているため、日本の独特な言語のニュアンスや文化、慣習をより深く理解することができます。また、パフォーマンスと効率性のバランスに優れており、「楽天エコシステム(経済圏)」のサービスを支える試験において、他社の同規模モデルを使用した場合と比較して、最大90%のコスト削減を実現しました(注5)。

なお、楽天は、次世代の日本語大規模言語モデルの研究開発のため、本年7月にGENIACの第3期公募に採択されました。本モデルの学習費用の一部は、生成AI開発に必要な計算資源として、「GENIAC」の補助を受けています。

楽天グループのChief AI & Data Officer(CAIDO)であるティン・ツァイは次のようにコメントしています。「楽天では、小規模なベンチャー企業からグローバルな大企業まで、すべての人々に変革をもたらす高品質でコスト効率の高いモデルの開発に注力しています。この戦略によって、ユーザー体験を豊かにし、価値のあるAIを提供することを目指しています。これまでで最も競争力のある本モデルの導入により、楽天のサービスは新たな段階へと進化します」

経済産業省AI産業戦略室長の渡辺 琢也氏は次のようにコメントしています。「高い性能を持つ大規模で効率的なAIモデル開発という成果を出されたことを歓迎いたします。この成果の社会実装を通じてAIエコシステムを拡大し、日本のAI産業をリードしていかれることを期待しています」

■大規模な事前学習を行った高効率モデル

本モデルは、計算効率を高めるため、約7,000億個のパラメータのうち、個々のトークンに対して約400億個のパラメータのみをアクティブ化しています。アクティブパラメータには3つの密な層とエキスパートコンポーネントが含まれ、各トークンは、常にアクティブな「共有エキスパート」と8つの「専門エキスパート」を経由します。この構造により、効率的な処理を行うことができます。大規模で複雑なデータセットでの迅速かつスケーラブルな学習を可能とするため、本モデルの学習は楽天が設計した社内マルチノードGPUクラスタ上で実行されました。楽天の隔離された安全なクラウド環境に展開しているため、データが外部に送信されることはありません。また、本モデルは日本の市場と楽天のビジネスニーズに最適化された豊富で高品質な独自データを用いてファインチューニングしているため、正確な処理を行うことができます。

■最高水準の日本語性能

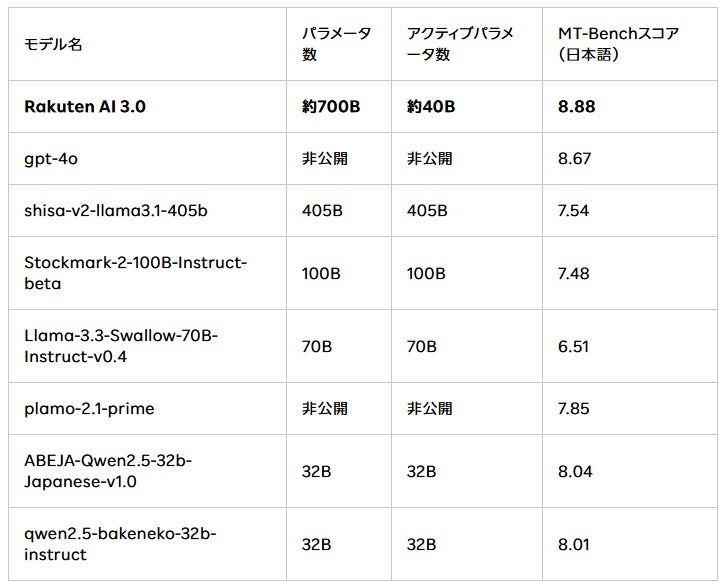

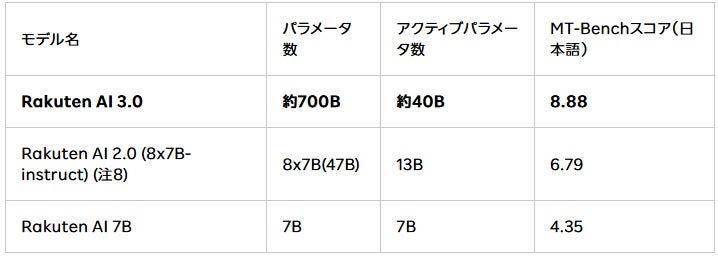

楽天は、基盤モデル(注6)の会話能力と指導追従能力のファインチューニングを行い、ペルソナの採用と維持、説得力のあるブログ記事の作成、専門用語に関する洞察の提供などといった行動におけるモデルの能力を評価する日本語版MT-Bench(注7)を使用してモデル評価を行いました。他の主なモデルや「Rakuten AI 2.0」インストラクションチューニング済モデル(注8)などの楽天の従来モデルとの比較スコアは、以下の表の通りです。

Rakuten AI 3.0 (LLM) と日本語に特化した主なモデルの比較

Rakuten AI大規模言語モデル比較

楽天は、楽天独自のモデル開発を通してLLMに関する知識と専門性を高め、「楽天エコシステム」をサポートするために最適化されたモデルを作成しています。今後も豊富なデータと最先端のAI技術の活用を通じて、世界中の人々へ新たな価値創出を目指してまいります。

(注1)エキスパートの混合モデルアーキテクチャはAIモデルアーキテクチャであり、モデルはエキスパートと呼ばれる複数のサブモデルに分割されています。推論とトレーニングの間、エキスパートのサブセットのみがアクティブ化され、入力を処理するために使用されます。

(注2)「Rakuten AIゲートウェイ」: 生成AI APIを統合した楽天従業員向けのプラットフォームとして、実験・開発・本番運用に必要なAPIを提供します。これにより、従業員は高度なAIエージェントを用いてコーディングおよび非コーディングのタスクを効率化することが可能となります。

(注3)「Rakuten AI」: 「楽天エコシステム」の重要なゲートウェイとして、ショッピング、金融(フィンテック)、旅行、エンターテインメントといった多岐にわたるサービスとシームレスに連携する先進的エージェント型AIツールです。楽天は、このツールの活用によって、主要サービス全体を横断するタスクを効率的に連携・調整し、一人ひとりのユーザーの好みに最適化したサポートを行っています。

(注4)2025年12月18日時点の開示情報に基づく自社調べ。これまでに楽天で開発した「Rakuten AI 7B」は約70億パラメータ、「Rakuten AI 2.0」は約470億パラメータです。

(注5)2025年12月18日時点の自社調べ。トークン(入力および出力)あたりにかかる費用を比較した場合。

(注6)基盤モデルとは、膨大な量のデータに対して事前にトレーニングされ、その後、特定のタスクやアプリケーションに適応するためにファインチューニングすることができるモデルのことです。

(注7)日本語版MT-Benchは、LLM を8つの側面(ライティング、ロールプレイ、推論、数学、コーディング、抽出、STEM、人文科学)で評価するために作られた80の挑戦的な質問からなる自由回答形式の評価データです。

https://arxiv.org/abs/2306.05685

回答に対する評価は、公開リーダーボードに沿って、比較と評価設定の透明性のために、GPT-4(gpt-4o-2024-08-06)を審査員として実施されます。

(注8)2025年2月に公開したLLM。「Rakuten AI 2.0」は、2024年3月に公開した「Rakuten AI 7B」モデルをベースとしています。なお、「Rakuten AI 2.0」のスコアは、公開リーダーボードに沿って、審査員モデルバージョンの変更により更新されています。

https://corp.rakuten.co.jp/news/press/2025/0212_02.html

以 上

このプレスリリースには、メディア関係者向けの情報があります

メディアユーザー登録を行うと、企業担当者の連絡先や、イベント・記者会見の情報など様々な特記情報を閲覧できます。※内容はプレスリリースにより異なります。

すべての画像

- 種類

- 商品サービス

- ビジネスカテゴリ

- システム・Webサイト・アプリ開発パソコンソフトウェア

- ダウンロード