菱洋エレクトロ、AIスーパーコンピューターの新製品 「NVIDIA DGX Station™ A100」の販売を開始

菱洋エレクトロ株式会社(本社:東京都中央区、代表取締役社長:中村守孝)は、AIコンピューティングの世界的リーダーであるNVIDIAが提供する「NVIDIA DGX Station™ A100」の販売を開始いたします。

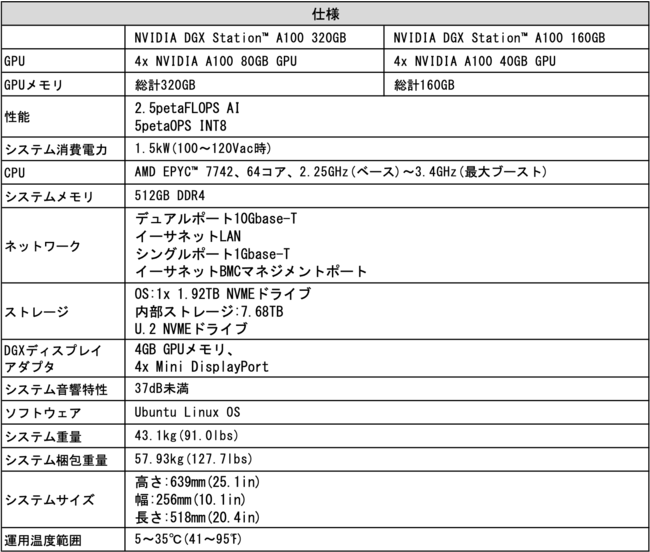

「NVIDIA DGX Station™ A100」は、AI(人工知能)の開発・研究のあらゆるワークロード(トレーニング、推論、データ分析)に必要な高度な演算処理を実現するNVIDIA® DGX™ ファミリーの中で、オフィスや研究室向けに設計された「NVIDIA DGX Station™ 」の最新モデルです。完全に相互接続された最新のNVIDIA AmpereアーキテクチャのNVIDIA A100 Tensor コア GPUを4基搭載し、GPUメモリが160GBモデルと320GBモデルの2種類のラインナップをご用意しています。

「NVIDIA DGX Station™ A100」は、以下のような特徴から、データセンターなどの専用の設備がない企業や教育機関でも、データセンター級のAIスーパーコンピューティングを実現します。

■冷却装置を水冷から冷媒冷却システムに変更

従来の冷却液を循環させるシステムから、エアコンのように熱交換を行う冷媒を使用したシステムに変更したことで、冷却液のメンテナンスや専用のサポートが不要になりました。

■2本のケーブルと通常の電源で動作可能

専用の電源は不要で、標準的な壁のコンセントに接続するだけで簡単にセットアップでき、世界最高峰のプラットフォームを数分で立ち上げて稼働させることが可能です。

通常、大規模なAIインフラストラクチャーを設置するには工業用の強力な電源装置や冷却機能を備えた大型データセンターを用意するなど、多大なIT投資が必要ですが、NVIDIA DGX Station™ A100は企業のオフィスや実験室、研究施設などお客様の作業スペースがどこにあっても利用できます。

さらに、NVIDIA A100 Tensor コア GPU独自のマルチインスタンスGPU(MIG)機能により、1つのGPUを最大7つに分割するシステムも使用可能です。NVIDIA DGX Station™ A100の4基のNVIDIA A100 Tensor コア GPUを最大28個のGPUインスタンスとして構成し、それぞれが独自の高帯域幅メモリ、キャッシュ、コンピューティングコアで完全分離できます。

菱洋エレクトロでは、現在NVIDIA DGX Station™ A100の注文受付を開始(*)しています。本製品の取り扱いにより、場所や環境を制限することなく、誰でも簡単にAIの開発・研究を実現できるソリューションを提供してまいります。

【製品仕様】

*最新のサポート内容については、NVIDIAのマニュアルを参照してください。

製品情報・購入につきましては以下 URL をご覧ください。

https://www.ryoyo.co.jp/product/iot/machine/nvidia/

※本リリースに記載されている情報は発表日現在のものです。このため、時間の経過あるいは後発的な 様々な事象によって内容に変更が生じる可能性がありますので、あらかじめご了承ください。

菱洋エレクトロ株式会社について

半導体/デバイス事業と ICT/ソリューション事業を手掛けるエレクトロニクス商社として、両事業を展開 する強みを生かした IoT/AI などをキーワードにしたビジネスに注力しています。最先端の半導体技術を お客様にご提案する一方、エッジからクラウドまでを幅広くサポートし、幅広い産業分野のお客様のビ ジネス課題の解決をご提案しています。

このプレスリリースには、メディア関係者向けの情報があります

メディアユーザーログイン既に登録済みの方はこちら

メディアユーザー登録を行うと、企業担当者の連絡先や、イベント・記者会見の情報など様々な特記情報を閲覧できます。※内容はプレスリリースにより異なります。

すべての画像