【デモあり】ELYZA、コード生成・補完に特化した日本語LLM「ELYZA-japanese-CodeLlama-7b」を一般公開

Metaのコード生成専用LLM「Code Llama」をベースに開発、商用利用も可能

下記の技術ブログ記事において、元々のモデルが持つ能力を保持出来ているか、またinstructionにおいて新たに日本語の能力を獲得することができたのかについて詳しい検証結果を示しています。ぜひご一読ください。

▼詳細はこちら▼

https://zenn.dev/elyza/articles/fcbf103e0a05b1

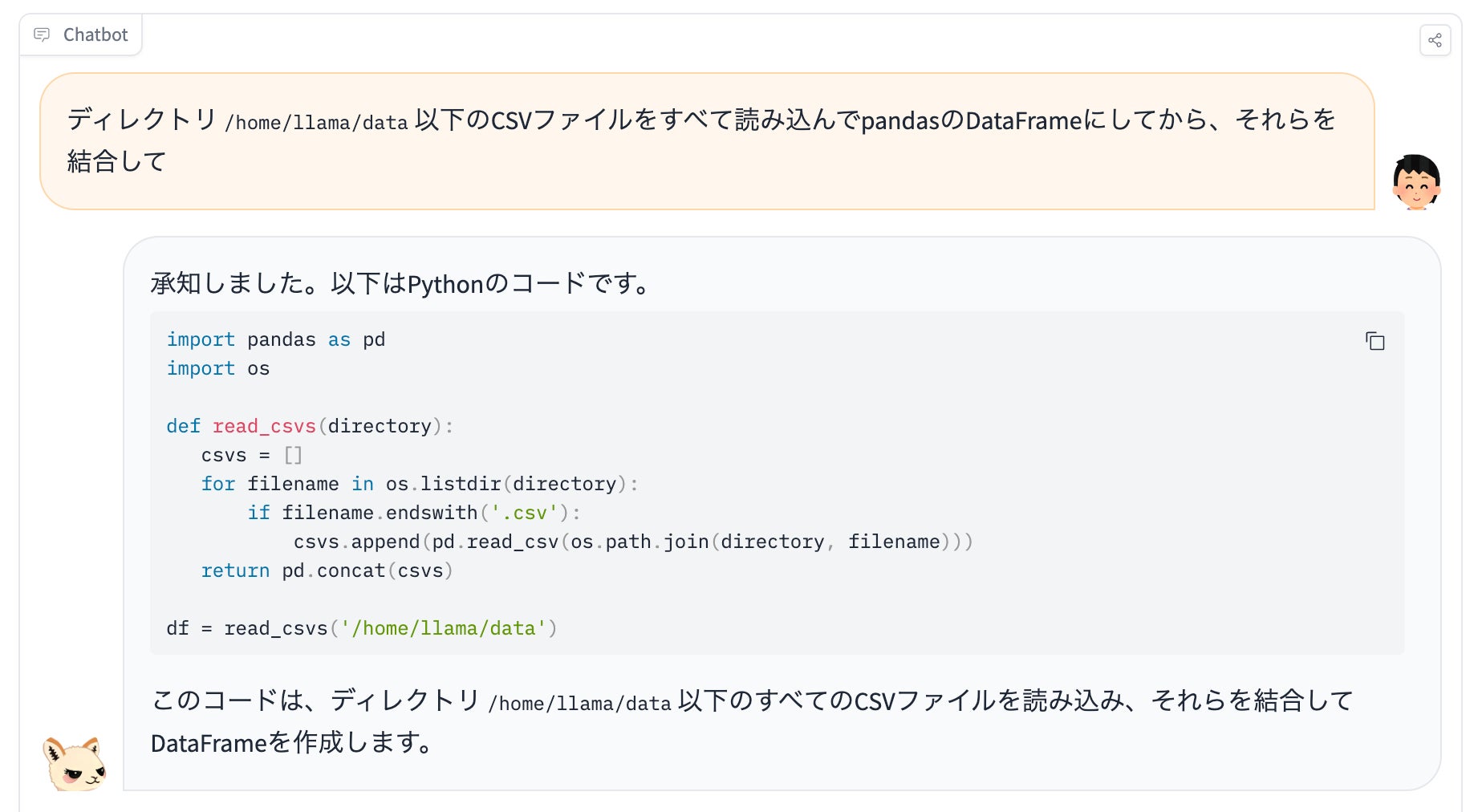

なお、本モデルを用いたchatUI形式のデモもHugging Face hub上で公開しております。

https://huggingface.co/spaces/elyza/ELYZA-japanese-CodeLlama-7b-instruct-demo

※アクセス過多によりリクエストが処理されるまで待ち時間が発生することがあります。

■「ELYZA-japanese-CodeLlama-7b」について

ELYZAでは、2023年8月時点で「Llama 2」をベースとした商用利用可能な日本語LLM「ELYZA-japanese-Llama-2-7b」を公開しています。( https://prtimes.jp/main/html/rd/p/000000034.000047565.html )

今回公開した「ELYZA-japanese-CodeLlama-7b」は、先般の開発でELYZAが用いた日本語の追加事前学習の一連のメソッドが、「Llama 2」以外のモデルでも汎用的に適用可能であるかを実験した取組みの一部で、元々のモデルが持つ能力を保持したまま日本語の能力を獲得できることを示す一例になると考えています。

サンプルとして、以下のような出力が可能です。

■「Code Llama」とは

「Code Llama」は「Llama 2」をベースとし、コード生成およびコード補完に関する能力を持つように追加で訓練されたモデルです。

「Code Llama」ではリポジトリレベルでの推論に対応するため扱える系列長が「Llama 2」と比べ4,096から100,000へと大幅に拡張されている点や、IDEなどでコードを補完する用途のために専用のチューニングがなされている点など、コードを扱うための工夫が多く盛り込まれています。また「Code Llama」をベースとしてfine tuningしたモデルが、様々なコード生成タスクでGPT-3.5 TurboやGPT-4に匹敵する性能を発揮することも報告されており、非常に注目されているモデルです。

Metaは「Llama 2」をベースとして70億、130億、340億のコードに特化した学習済みモデルの他、Python特化モデルと指示学習済みモデルの3種のモデルを公開しています。

■ELYZA会社概要

株式会社ELYZAは、「未踏の領域で、あたりまえを創る」という理念のもと、日本語の大規模言語モデルに焦点を当て、企業との共同研究やクラウドサービスの開発を行なっております。先端技術の研究開発とコンサルティングによって、企業成長に貢献する形で言語生成AIの導入実装を推進します。

<会社概要>

社名 :株式会社ELYZA

所在地 :〒113-0033 東京都文京区本郷3-15-9 SWTビル 6F

代表者 :代表取締役 曽根岡侑也

設立 :2018年9月

URL :https://elyza.ai/

このプレスリリースには、メディア関係者向けの情報があります

メディアユーザー登録を行うと、企業担当者の連絡先や、イベント・記者会見の情報など様々な特記情報を閲覧できます。※内容はプレスリリースにより異なります。

すべての画像