アリババクラウド、次世代AIイノベーションに向けた戦略ロードマップを発表

AIモデルからエージェント開発・応用プラットフォーム、インフラまで、フルスタックのAI製品群を「Apsara Conference 2025」にて発表

アリババグループのデジタルテクノロジーおよびデータインテリジェンスの中核を担うアリババクラウドは本日、同社の年次主力テクノロジーカンファレンス「Apsara Conference 2025」にて、最新のフルスタックAIイノベーションを発表しました。今回の発表では、次世代大規模言語モデルファミリー「Qwen3」、次期画像生成モデル「Wan2.5」、強化されたエージェント開発・応用プラットフォーム、AIインフラの大幅なアップグレードまで、多岐にわたる内容となり、同社が新たなAI時代の最前線で世界的リーダーシップを強化していることを示しています。

アリババクラウド・インテリジェンスの会長兼最高経営責任者(CEO)である呉 泳銘(エディー・ウー)は、次のように述べています。

「将来、大規模AIモデルは様々なデバイスに深く統合され、オペレーティングシステムのような役割を果たすようになるでしょう。永続的なメモリー、クラウドとエッジのシームレスな連携、そして継続的に進化する能力を備えるようになります。当社はQwenのオープンソース化を継続し、それを『AI時代のオペレーティングシステム』へと進化させることに注力しています。これにより、世界中の開発者が変革的なAIアプリケーションを構築できるよう支援します。同時に、アリババクラウドは戦略的にフルスタックのAIサービスプロバイダーとして位置づけられ、クラウド上で大規模AIモデルのトレーニングおよびデプロイにおいて最大効率の堅牢なコンピューティングを提供することに注力しています。AIの進化を推進するという当社の長期的コミットメントを示すため、今後3年間で3,800億人民元規模のAIおよびクラウドインフラへの投資計画を推進します。」

2023年初代Qwenを発表して以来、アリババは大規模言語モデル「Qwen」と画像生成モデル「Wan」という2つの基盤モデルをベースに構築された300以上のAIモデルをオープンソース化してきました。これらのモデルは累計6億回以上ダウンロードされ、17万以上の派生モデルが作成されており、世界で最も広く採用されているオープンソースAIシリーズの一つとなっています。特に、100万を超える企業や個人がアリババのAI開発プラットフォーム「Model Studio」でQwenを活用しています。

Qwen3-Max発表:アリババ史上最強のLLM

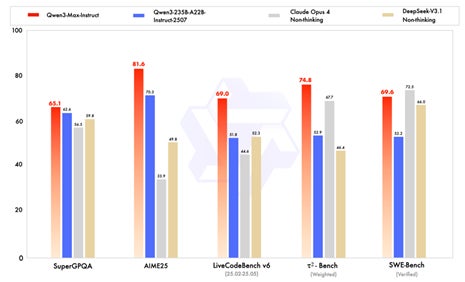

アリババは、1兆以上のパラメータを持つ最大のLLMモデル「Qwen3-Max」を正式に公開しました。本モデルは、Instruct(非推論)モードとThinking(推論)モードを備え、特にコード生成やエージェント能力で優れた性能を発揮します。Instructモードでは、実世界のソフトウェア課題解決能力を評価する権威あるベンチマーク「SWE-Bench」で69.6点を記録し、一部の主要なクローズドソースモデルと同等の水準に達しました。また、会話型エージェントを評価する「Tau2-Bench」でも顕著な性能を記録し、知能的で行動指向のエージェント構築の基盤となる「ツール利用能力」において卓越した習熟度を示しています。

カンファレンスでは、ビジュアル言語処理とマルチモーダル処理に対応する一連のQwen3モデルも発表されました。

-

Qwen3-VL: Qwen3-VLは、Qwenファミリーで最も高性能なビジョン言語モデルです。MoE(Mixture-of-Experts)アーキテクチャにより、エッジデバイスから高性能クラウド環境まで柔軟な展開が可能です。ビジュアルエージェントとして機能するQwen3-VLは、PCおよびモバイルの両インターフェースで動作可能で、画像や動画から直接コードを生成するビジュアルプログラミングを実現し、視覚的デザインを機能的なアプリケーションへと変換します。また、空間理解能力は、方向と距離の認識を強化した3Dグラウンディングに対応し、エンボディAIや現実世界の空間ナビゲーションの基盤構築に寄与します。Qwen3-VL-235B-A22BはInstruct版とThinking版の両方で利用可能で、主要な視覚認識およびマルチモーダル推論ベンチマークで高い性能を達成しています。

-

Qwen3-Omni: Qwen3-Omniは、テキスト、画像、音声、動画を処理可能なネイティブエンドツーエンドの多言語対応のオムニモデルであり、テキストと自然言語の両方でリアルタイムストリーミング対応を実現します。同モデルは、革新的なThinker–Talker MoEアーキテクチャを搭載し、2,000万時間分の音声データで事前学習されています。その結果、最大30分の音声入力や動画ベースの対話において優れた理解能力を発揮しながら、テキストおよび画像処理能力も保持しています。また、超低レイテンシによるリアルタイムのマルチモーダルインタラクションを実現し、インテリジェントコックピット、スマートグラス、モバイル端末における直感的でハンズフリーの対話に理想的なソリューションとなっています。Qwen3-Omni-30B-A3Bは現在、Hugging FaceおよびアリババクラウドのModelScopeコミュニティーでオープンソース化されています。ユーザーはさまざまなQwenモデルを体験できるウェブアプリケーション「Qwen Chat」を通じてQwen3-Omni-Flashにもアクセス可能です。

さらに、Qwen3-CoderとQwen3-Image-Editも大幅にアップグレードされました。新しいQwen3-Coderは、推論速度の向上に加え、コードの安全性も強化されています。一方、Qwen3-Image-Editは、複数の画像を同時に編集できる機能をサポートするとともに、視覚的一貫性が大幅に向上しています。

アリババはまた、高度な多言語音声認識および音声合成機能を備えた音声LLMファミリー「Fun」を発表しました。このシリーズには、実世界の企業向けに最適化されたエンドツーエンドの自動音声認識モデル「Fun-ASR」と、複数言語で自然な音声出力を生成する高品質で表現豊かな音声合成モデル「Fun-CosyVoice」が含まれます。

Wan2.5プレビュー:マルチメディアコンテンツ制作を革新

同カンファレンスでは、アリババは最新の動画生成モデル、画像生成モデル、画像編集モデルを含む4種類のWan2.5モデルを先行公開しました。動画生成モデルは動画用の高忠実度の音声生成をネイティブにサポートし、動画の長さを従来の5秒から10秒へ倍増し、より完全で一貫性のあるナラティブをより高品質な映像で実現します。これらのモデルは、テキスト・音声・視覚データを統合的に学習したマルチモーダルアーキテクチャを採用しており、音声と視覚コンテンツの同期を保証するマルチモーダル生成を実現し、ユーザーの指示を忠実に反映する高度な指示理解能力を強化しています。

新たな開発フレームワークでエージェント展開を強化

AIエージェントの大規模実装を効率化するために、アリババクラウドはAI開発プラットフォーム「Model Studio」に新しい開発フレームワークを追加しました。新たに導入された Model Studio-ADK(エージェント開発キット) は、エンタープライズの専門家向けの高コード(high-code)開発フレームワークとして、複雑なビジネス要件を実行可能なエージェントロジックへと変換します。これにより、自律的な意思決定、動的リフレクション、反復的なタスク実行機能を備えた高度なAIエージェントの迅速な開発を実現します。注目すべきは、この堅牢なツールキットを活用することで、DeepResearchやAgentic RAG(Retrieval-Augmented Generation、検索拡張生成)プロジェクトを1時間以内に作成できる点です。Model Studioは同時に、プログラミング知識が限られたユーザーでも軽量AIエージェントを容易に作成できる低コード(low-code)開発プラットフォーム「Model Studio-ADP(エージェント開発プラットフォーム)」も強化しました。

さらに、マルチソースデータ処理、リソース制約、クロス環境での展開といった主要な企業課題を解決するため、「Model Studio Agent」は一連の企業向け機能を導入しました。これには、Model Context Protocol(MCP)によるシームレスな接続性、RAGマルチモーダル融合、動的推論スケジューリング、サンドボックスサービスなどが含まれ、企業がAIエージェントの導入を加速することを可能にします。

現在、Model Studioを通じて200以上の業界最先端モデル(自社開発のQwenやWanを含む)にアクセス可能であり、これまでに80万以上のエージェントが作成されています。コンテンツ制作、インテリジェントマーケティング、スマートホーム管理、生産最適化など多様なシナリオを支援しています。過去12か月間でModel Studioを通じたモデル呼び出し回数は15倍に増加しており、堅牢かつスケーラブルなAIソリューションへの需要の高まりを反映しています。

企業とクリエイターを支援する新AIプラットフォーム

7月の初公開に続き、アリババクラウドは、企業・開発者・AIパートナー向けのマルチモーダル・クラウドベース実行環境兼エキスパートエージェントプラットフォーム「AgentBay」を大幅にアップグレードしました。新たに追加されたSelf-Evolving Engine、カスタムコンテナイメージ、組み込みの安全性・コンプライアンス制御により、エージェントは単純な単一モデルの補助から、人間のように複合的でマルチモーダルなワーカーへと進化し、タスクをエンドツーエンドで完遂できるようになります。

企業におけるAI駆動の成長需要の高まりに応えるため、アリババクラウドはワンストップの法人向けAIアプリケーションプラットフォーム「Lingyang AgentOne」も発表しました。同プラットフォームは、組織が受動的対応から能動的インテリジェンスへ移行することを可能にします。アリババ独自のQwenモデルを搭載し、アリババエコシステムと深く統合されたLingyang AgentOneは、既存システムと連携して価値創出までの時間を短縮するエンドツーエンドのエージェント開発環境を提供します。さらに、マーケティング、分析、カスタマーサービス、運用にわたるシナリオベースのソリューションを通じて、販売前・販売中・販売後のバリューチェーン全体を結び付け、住宅リフォームやEコマースといった業界で測定可能で実運用可能な成果を提供します。

加えて、アリババの消費者向けAIアプリケーションプラットフォーム「Quark」は、ワンストップのAI画像・動画制作プラットフォーム「Zaodian(造点)」をローンチしました。Zaodianは、アリババの主力動画生成モデル「Wan」をはじめとする業界最先端のAIモデルを統合し、クリエイターにプロフェッショナルで効率的な制作体験を提供します。Wanがサポートするテキストから動画生成、画像から動画生成機能に加え、Zaodianは複数の主要モデルを選択できるAI画像生成・編集機能も提供しています。クリエイターは公式サイト(zaodian.quark.cn)またはQuarkデスクトップ版「AI画像」からサービスを利用できます。

エージェントAIを支える次世代AIインフラストラクチャ

カンファレンスにおいて、アリババクラウドは、新たに登場したエージェントAIの発展を支援するために特別に設計された、包括的かつ革新的なインフラストラクチャアップグレードのスイートを発表しました。

-

ストレージ:アリババクラウドは、Object Storage Service(OSS)を「Vector Bucket」で強化しました。これは、コスト効率の高い大規模ベクトルデータの保存および検索を可能にするAI搭載機能であり、RAGおよびAIアプリケーション向けに最適化されています。生データとベクトルデータの管理をOSSに統合し、標準APIを介してアクセスできるため、スケーラブルなRAGプラットフォームの開発やマルチメディア資産の整理が容易になります。これにより、企業は生データとベクトルデータを一元的に管理でき、AI開発コストを削減し、複雑性を低減してRAGアプリケーションの展開を加速できます。

-

ネットワーク:アリババクラウドは、AIモデル専用に設計された高性能ネットワークの最新アーキテクチャ「HPN8.0」を発表しました。このアーキテクチャにより、混合計算ワークロード全体でシームレスなモデルのトレーニング、推論、強化学習を実行でき、超大規模なデプロイメントをサポートします。HPN8.0は800Gbpsのネットワークスループットを提供し、前世代と比較して容量を2倍に向上させています。

-

セキュリティ:アリババクラウドは、Cloud Threat Detection Response(CTDR、クラウド脅威検知・対応)ソリューションにAI駆動のエージェント機能を追加しました。このクラウドネイティブなセキュリティ強化により、検知、分析、対応の能力が向上し、セキュリティ脅威に対してよりインテリジェントかつ事前対応的なアプローチを可能にします。Qwenを搭載した5つのAIエージェントが、アラート評価から実行までを自動化し、知的分析、イベント相関、実用的なレポート作成を通じてエンドツーエンドの脅威管理を実現します。新機能により、自動インシデント調査の成功率は59%から74%に効果的に向上し、70%の自動対応アクションが人的介入なしに処理されるようになりました。

-

コンテナ:アリババクラウドは、最適化されたスケジューリングおよびコンテナイメージキャッシュ高速化技術を通じて自動スケーリング機能を強化するため、Container Compute Services(ACS)をアップグレードしました。これにより、1分あたり最大15,000ポッドのスケーリングをサポートする弾力性が実現され、大規模かつ高並行性のエージェントリクエストを効率的に処理できます。さらに、ACSのコンテナサンドボックス技術はユーザースペースをランタイム環境から分離することで強力な隔離を実現し、あるエージェントにおける脆弱性やデータ漏洩が他のエージェントに影響を与えることを防ぎます。

-

データベース:アリババクラウドは、PolarDBデータベースをアップグレードし、データとAIワークロードの統合に最適化しました。このアップグレードには、Compute Express Link(CXL)技術を活用したハードウェアイノベーションが導入されました。高効率な演算メモリ間接続により、レイテンシを72.3%削減し、メモリスケーラビリティを16倍向上させ、データおよびAIワークロードの強固な基盤を構築します。さらに、アップグレードされたPolarDBは、新しいLakebaseアーキテクチャを導入し、レイク、運用データベース、メタデータを含むハイブリッドストレージにより、Lance、Iceberg、Apache Hudiなどの一般的なオープンデータフォーマットを格納可能としました。これにより、ストレージコストの削減と効率的なマルチモーダルデータの保存および管理を実現します。

-

AIプラットフォーム(PAI):アリババクラウドのPAIは、大規模モデル開発をエージェントAI時代に適合させるための相乗的な最適化を導入しました。革新的なMoEトレーニング加速技術によりQwenシリーズのトレーニング速度が300%以上向上し、アップグレードされたDiTトレーニングエンジンはWanシリーズの単一サンプルあたりのトレーニング時間を28.1%短縮しました。推論機能も強化され、トランザクション処理性能は71%向上し、TPOTレイテンシは70.6%削減、インフラストラクチャのスケーリング速度は97.6%高速化しました。

このプレスリリースには、メディア関係者向けの情報があります

メディアユーザー登録を行うと、企業担当者の連絡先や、イベント・記者会見の情報など様々な特記情報を閲覧できます。※内容はプレスリリースにより異なります。

すべての画像