音声認識性能向上手法に関する技術論文が世界最大規模の音声処理系国際学会「INTERSPEECH 2021」にて採択されました

株式会社アドバンスト・メディア(本社:東京都豊島区、代表取締役会長兼社長:鈴木清幸 以下、アドバンスト・メディア)は、音声認識性能向上手法に関する技術論文が、世界最大規模の音声処理系国際学会「INTERSPEECH 2021」にて採択されましたので、お知らせいたします。

「INTERSPEECH」は、International Speech Communication Association(ISCA)が主催する世界最大規模の音声処理系国際会議です。この度、論文「Knowledge Distillation for Streaming Transformer–Transducer」が「INTERSPEECH2021」にて採択されました。

近年の音声認識では、End-to-Endのモデルによるものが盛んに研究されており、高い認識性能が得られることが報告されています。1つのニューラルネットワークで構成され、容量が軽いというメリットがありますが、一方で時間について双方向のLSTMの層を持つことから、ストリーミング処理に難点があります。双方向性を無くすなどの制限によりストリーミング処理への対応が検討されていますが、認識性能の低下が避けられませんでした。

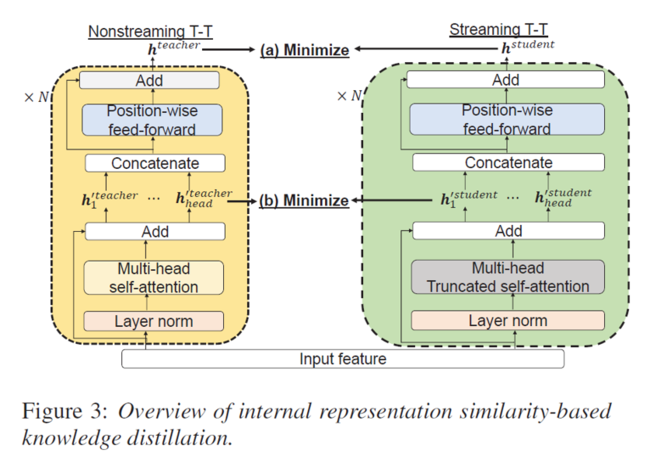

この性能低下の課題を解決するため、ストリーミングに対応したTransformer-Transducerモデルの学習を、知識蒸留で行う手法を提案しました。着目する層を変えるなどの工夫により、ストリーミング処理に対応しながら従来のモデルに匹敵する認識性能を持つモデルが得られています。

Multi-head Full Attention ←→ Multi-Head Truncated self-attention

■採択された論文

Atsushi Kojima "Knowledge Distillation for Streaming Transformer–Transducer".

アドバンスト・メディアでは、今後も継続的に技術開発を進め、お客様の業務の効率化・価値創造に貢献するソリューションやサービスの提供に努めてまいります。

以上

【本件のお問い合わせ】

株式会社アドバンスト・メディア

広報・IRグループ

MAIL:press@advanced-media.co.jp

https://www.advanced-media.co.jp/

近年の音声認識では、End-to-Endのモデルによるものが盛んに研究されており、高い認識性能が得られることが報告されています。1つのニューラルネットワークで構成され、容量が軽いというメリットがありますが、一方で時間について双方向のLSTMの層を持つことから、ストリーミング処理に難点があります。双方向性を無くすなどの制限によりストリーミング処理への対応が検討されていますが、認識性能の低下が避けられませんでした。

この性能低下の課題を解決するため、ストリーミングに対応したTransformer-Transducerモデルの学習を、知識蒸留で行う手法を提案しました。着目する層を変えるなどの工夫により、ストリーミング処理に対応しながら従来のモデルに匹敵する認識性能を持つモデルが得られています。

Multi-head Full Attention ←→ Multi-Head Truncated self-attention

■採択された論文

Atsushi Kojima "Knowledge Distillation for Streaming Transformer–Transducer".

アドバンスト・メディアでは、今後も継続的に技術開発を進め、お客様の業務の効率化・価値創造に貢献するソリューションやサービスの提供に努めてまいります。

以上

【本件のお問い合わせ】

株式会社アドバンスト・メディア

広報・IRグループ

MAIL:press@advanced-media.co.jp

https://www.advanced-media.co.jp/

このプレスリリースには、メディア関係者向けの情報があります

メディアユーザーログイン既に登録済みの方はこちら

メディアユーザー登録を行うと、企業担当者の連絡先や、イベント・記者会見の情報など様々な特記情報を閲覧できます。※内容はプレスリリースにより異なります。

すべての画像

- 種類

- その他

- ビジネスカテゴリ

- システム・Webサイト・アプリ開発アプリケーション・セキュリティ

- ダウンロード