rinna社、日本語に特化した画像生成モデル「Japanese Stable Diffusion」を公開

〜日本語画像生成モデルの公開と画像生成サービスの開始〜

rinna株式会社(本社:東京都渋谷区/代表取締役:ジャン“クリフ”チェン、以下rinna社)は、日本語に特化した画像生成モデル「Japanese Stable Diffusion」を公開します。また、このモデルを用いた画像生成サービスも提供開始します。

■背景

rinna株式会社は「人とAIの共創世界」をビジョンに掲げ、人と人との間にAIが介在することによる豊かなコミュニケーションを通して、すべての人が自分らしい創造性を発揮できる社会の実現を目指しています。その取り組みの中で、画像などの非言語コミュニケーションを重要視し、かねてよりAIりんなをはじめとしたAIキャラクターが発信する画像生成や、研究成果として学習済みの言語画像モデルを公開してきました。

rinna社の考えるAIとの共存は、「AIによる人間の創造性の発展」です。「あなたらしい創造力をAIキャラクターと共に引き出し、世界をカラフルに。」をミッションとするrinna社として、このたび公開する画像生成モデル「Japanese Stable Diffusion」が多様な人々の創造性を後押しすることを願っています。

■概要

これまでrinna社は、日本語に特化した言語モデルGPT・BERTや言語と画像の関係を表現する言語画像モデルCLIPなどを公開し、多くの研究・開発者にご利用いただいています。

2022年の春以降、DALL-E 2・Midjourney・Stable Diffusionといった精度の高いAI画像生成が話題となっています。このたび当社は、Stability AI社がオープンソースで公開する画像生成モデルStable Diffusionに、日本語のキャプション付き画像を用いて追加学習することで、日本語に特化した画像生成モデル「Japanese Stable Diffusion」を開発しました。本モデルにより、テキストプロンプトとして日本語を考慮し、翻訳では表現が難しい日本語圏の文化を反映した画像生成を実現します。そしてAIモデルライブラリHugging FaceとGitHubでこのモデルを公開することにより、言語・画像の研究・開発コミュニティに還元いたします。

・Hugging Face:https://huggingface.co/rinna/japanese-stable-diffusion

・GitHub:https://github.com/rinnakk/japanese-stable-diffusion

そして、当社の運営するサービス『キャラる』やSNSにも本モデルを実装し「Japanese Stable Diffusion」の画像生成が体験できるようになりました。

好評配信中のAIキャラクターSNS『キャラる』では、「お絵描き上手」などのバッジをAIキャラクターに付与することにより、AIキャラクターが自発的に Japanese Stable Diffusion での画像生成を行います。また、『キャラる』の公式Discordでは、「#🎨|aiお絵描き会場」のチャンネルを開設し、botの「Tsukuru(ツクる)」を呼び出すことで日本語で入力したプロンプトから画像の生成を行うことができます。

※利用規約 < https://rinna.co.jp/tsukuru-terms-of-use > への同意が必要です。

・『キャラる』公式サイト:https://www.chararu.jp/

・『キャラる』公式Discord:https://tinyurl.com/chararu

当社Chief AI Communicatorのりんなの特定のツイートにリプライを送ると Japanese Stable Diffusion から生成された画像が返信されます。

・AIりんな 公式Twitter:https://twitter.com/ms_rinna

・リプライを送ると画像が生成されるツイート:https://twitter.com/ms_rinna/status/1567844022240313344?

開発者向けに公開しているAPIサイトのrinna Developersでも、本モデルを使用したAPI「Text To Image API v2」を公開いたしました。このAPIを使用することで、「Japanese Stable Diffusion」での画像生成機能をアプリケーション等に実装することができます。

※ご利用にはユーザー登録とrinna Developersの利用規約 < https://developers.rinna.co.jp/terms-of-use#EHZff > への同意が必要です。

・rinna Developers:https://developers.rinna.co.jp/

■Stable Diffusionの解説

昨今、画像生成タスクにおいてDiffusion Modelが高性能であると報告されています。一般的に、Diffusion Modelを基にしたテキスト条件付き画像生成モデルでは、テキストを解釈するテキストエンコーダーと、そのテキストエンコーダーの出力から画像を生成するモデルの2つから構成されます。Stability AI社により公開されたテキスト条件付き画像生成モデルであるStable Diffusionは、テキストエンコーダーとしてOpenAI社によって学習された事前言語画像モデルCLIPを利用し、生成モデルにはDiffusion Modelの改良版であるLatent Diffusion Modelを用います。学習時には、テキストエンコーダーであるCLIPのパラメータは固定し、生成モデルであるLatent Diffusion Modelのみを更新することで、OpenAI社の優れたCLIPを活かします。Stable Diffusionの学習データには、LAION-5Bの英語サブセットである23億枚のキャプション付き画像が用いられており、テキストプロンプトを入力するだけで高性能な画像を生成することができます。また、高性能であるにも関わらず、10GB VRAM GPU程度のコンピューティングコストで推論が動作し、手軽に使用できるという特徴もあります。

■Japanese Stable Diffusionの開発背景と特徴

Stable Diffusionは、英語のキャプション付き画像から学習されているため、日本語から画像を生成するためには、英語に翻訳したテキストプロンプトを用意する必要があります。しかし、日本語固有の表現(例えば固有名詞、和製英語、オノマトペ)は、翻訳が難しく画像生成に反映させることはできません。また、学習データの多くは英語圏の画像であり、英語圏の文化を色濃く反映した画像が生成されます。そこで当社では、日本語に特化した画像生成モデルである「Japanese Stable Diffusion」を開発しました。このモデルには以下の特徴があります。

・学習データとして、LAION-5Bの日本語サブセットをはじめとした約1億枚の日本語キャプション付き画像を利用しました。

・日本語のテキストプロンプトに対応させるために、Stability AI社が公開したStable Diffusionの生成モデルパラメータを固定し、テキストエンコーダーのみ日本語キャプション付き画像を用いて追加学習を行いました。その後、テキストエンコーダーと生成モデルのパラメータを同時に更新する追加学習を行うことにより、さらに日本語の画像生成に最適化しました。

・学習された「Japanese Stable Diffusion」は、Stable DiffusionのライセンスCreativeML Open RAIL-Mを継承しHugging Faceにて公開しました。

・劇的に進歩するAI分野において、英語圏の進歩に追随するために早期にモデルを公開しました。

・以下、日本語のテキストプロンプトから生成された画像のサンプルです。

■今後の展開

当社は今後もAIに関する研究を続け、高性能な製品・サービスの開発を目指します。研究成果については引き続き公開し、研究・開発コミュニティへ還元してまいります。

また、近年ではAIモデルを用いた文章生成や画像生成により魅力的なコンテンツを生み出すためのテキストプロンプトが重要視され、AIの力を最大限に引き出すことのできるスペシャリストを求める動きが活発になっています。 AIも人もいきいきと活躍できる社会を目指す rinna社では、テキストプロンプトを専門に扱うプロンプトエンジニアのポジションを新設し採用活動を進めています。AIの社会実装を推進するにあたり、rinna社はAIに関わる雇用機会の創出も積極的に行ってまいります。

・プロンプトエンジニアの採用情報はこちら

https://www.hireplanner.com/ja/frontend/companies/240/jobs/4444

【rinna株式会社について】

2020年6⽉に設⽴したAIキャラクター開発企業です。「あなたらしい創造力をAIキャラクターと共に引き出し、世界をカラフルに。」をミッションに掲げ、人と人、人と情報、人と社会との繋がりやコミュニケーションの新しいあり方を提案します。任意の人格の口調や学習トピックを反映し、自然な会話をするAIキャラクターを作成できる「Tamashiru」、社内コミュニケーションの透明性を高め、組織の繋がりを強くする「Coordiru」、自分のAIキャラクターを育成し、他のAIキャラクターと交流するSNSアプリ「キャラる」などを提供しています。

rinna株式会社は「人とAIの共創世界」をビジョンに掲げ、人と人との間にAIが介在することによる豊かなコミュニケーションを通して、すべての人が自分らしい創造性を発揮できる社会の実現を目指しています。その取り組みの中で、画像などの非言語コミュニケーションを重要視し、かねてよりAIりんなをはじめとしたAIキャラクターが発信する画像生成や、研究成果として学習済みの言語画像モデルを公開してきました。

rinna社の考えるAIとの共存は、「AIによる人間の創造性の発展」です。「あなたらしい創造力をAIキャラクターと共に引き出し、世界をカラフルに。」をミッションとするrinna社として、このたび公開する画像生成モデル「Japanese Stable Diffusion」が多様な人々の創造性を後押しすることを願っています。

■概要

これまでrinna社は、日本語に特化した言語モデルGPT・BERTや言語と画像の関係を表現する言語画像モデルCLIPなどを公開し、多くの研究・開発者にご利用いただいています。

2022年の春以降、DALL-E 2・Midjourney・Stable Diffusionといった精度の高いAI画像生成が話題となっています。このたび当社は、Stability AI社がオープンソースで公開する画像生成モデルStable Diffusionに、日本語のキャプション付き画像を用いて追加学習することで、日本語に特化した画像生成モデル「Japanese Stable Diffusion」を開発しました。本モデルにより、テキストプロンプトとして日本語を考慮し、翻訳では表現が難しい日本語圏の文化を反映した画像生成を実現します。そしてAIモデルライブラリHugging FaceとGitHubでこのモデルを公開することにより、言語・画像の研究・開発コミュニティに還元いたします。

・Hugging Face:https://huggingface.co/rinna/japanese-stable-diffusion

・GitHub:https://github.com/rinnakk/japanese-stable-diffusion

そして、当社の運営するサービス『キャラる』やSNSにも本モデルを実装し「Japanese Stable Diffusion」の画像生成が体験できるようになりました。

好評配信中のAIキャラクターSNS『キャラる』では、「お絵描き上手」などのバッジをAIキャラクターに付与することにより、AIキャラクターが自発的に Japanese Stable Diffusion での画像生成を行います。また、『キャラる』の公式Discordでは、「#🎨|aiお絵描き会場」のチャンネルを開設し、botの「Tsukuru(ツクる)」を呼び出すことで日本語で入力したプロンプトから画像の生成を行うことができます。

※利用規約 < https://rinna.co.jp/tsukuru-terms-of-use > への同意が必要です。

・『キャラる』公式サイト:https://www.chararu.jp/

・『キャラる』公式Discord:https://tinyurl.com/chararu

当社Chief AI Communicatorのりんなの特定のツイートにリプライを送ると Japanese Stable Diffusion から生成された画像が返信されます。

・AIりんな 公式Twitter:https://twitter.com/ms_rinna

・リプライを送ると画像が生成されるツイート:https://twitter.com/ms_rinna/status/1567844022240313344?

開発者向けに公開しているAPIサイトのrinna Developersでも、本モデルを使用したAPI「Text To Image API v2」を公開いたしました。このAPIを使用することで、「Japanese Stable Diffusion」での画像生成機能をアプリケーション等に実装することができます。

※ご利用にはユーザー登録とrinna Developersの利用規約 < https://developers.rinna.co.jp/terms-of-use#EHZff > への同意が必要です。

・rinna Developers:https://developers.rinna.co.jp/

■Stable Diffusionの解説

昨今、画像生成タスクにおいてDiffusion Modelが高性能であると報告されています。一般的に、Diffusion Modelを基にしたテキスト条件付き画像生成モデルでは、テキストを解釈するテキストエンコーダーと、そのテキストエンコーダーの出力から画像を生成するモデルの2つから構成されます。Stability AI社により公開されたテキスト条件付き画像生成モデルであるStable Diffusionは、テキストエンコーダーとしてOpenAI社によって学習された事前言語画像モデルCLIPを利用し、生成モデルにはDiffusion Modelの改良版であるLatent Diffusion Modelを用います。学習時には、テキストエンコーダーであるCLIPのパラメータは固定し、生成モデルであるLatent Diffusion Modelのみを更新することで、OpenAI社の優れたCLIPを活かします。Stable Diffusionの学習データには、LAION-5Bの英語サブセットである23億枚のキャプション付き画像が用いられており、テキストプロンプトを入力するだけで高性能な画像を生成することができます。また、高性能であるにも関わらず、10GB VRAM GPU程度のコンピューティングコストで推論が動作し、手軽に使用できるという特徴もあります。

■Japanese Stable Diffusionの開発背景と特徴

Stable Diffusionは、英語のキャプション付き画像から学習されているため、日本語から画像を生成するためには、英語に翻訳したテキストプロンプトを用意する必要があります。しかし、日本語固有の表現(例えば固有名詞、和製英語、オノマトペ)は、翻訳が難しく画像生成に反映させることはできません。また、学習データの多くは英語圏の画像であり、英語圏の文化を色濃く反映した画像が生成されます。そこで当社では、日本語に特化した画像生成モデルである「Japanese Stable Diffusion」を開発しました。このモデルには以下の特徴があります。

・学習データとして、LAION-5Bの日本語サブセットをはじめとした約1億枚の日本語キャプション付き画像を利用しました。

・日本語のテキストプロンプトに対応させるために、Stability AI社が公開したStable Diffusionの生成モデルパラメータを固定し、テキストエンコーダーのみ日本語キャプション付き画像を用いて追加学習を行いました。その後、テキストエンコーダーと生成モデルのパラメータを同時に更新する追加学習を行うことにより、さらに日本語の画像生成に最適化しました。

・学習された「Japanese Stable Diffusion」は、Stable DiffusionのライセンスCreativeML Open RAIL-Mを継承しHugging Faceにて公開しました。

・劇的に進歩するAI分野において、英語圏の進歩に追随するために早期にモデルを公開しました。

・以下、日本語のテキストプロンプトから生成された画像のサンプルです。

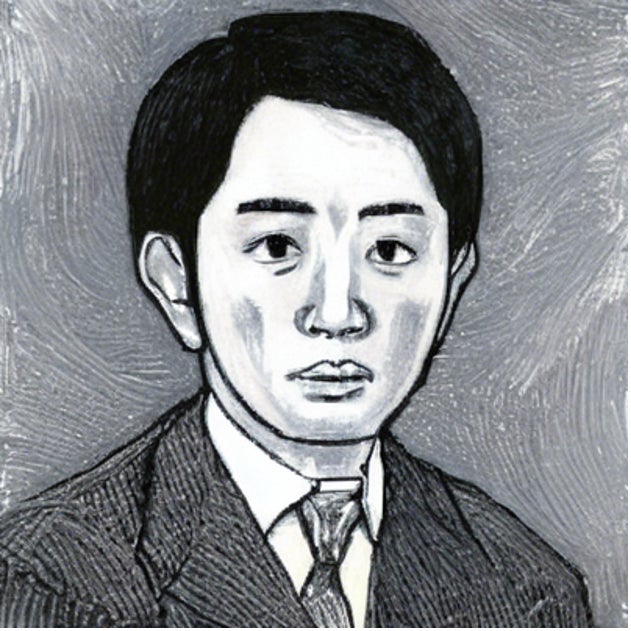

「サラリーマン 油絵」

「サラリーマン 油絵」

「夕暮れの神社の夏祭りを描いた水彩画」

「夕暮れの神社の夏祭りを描いた水彩画」

「ハンバーガー 浮世絵」

「ハンバーガー 浮世絵」

「キラキラ瞳の猫」

「キラキラ瞳の猫」

「宇宙の月でバイクで走るライダー」

「宇宙の月でバイクで走るライダー」

「かわいいわんこのイラスト」

「かわいいわんこのイラスト」

■今後の展開

当社は今後もAIに関する研究を続け、高性能な製品・サービスの開発を目指します。研究成果については引き続き公開し、研究・開発コミュニティへ還元してまいります。

また、近年ではAIモデルを用いた文章生成や画像生成により魅力的なコンテンツを生み出すためのテキストプロンプトが重要視され、AIの力を最大限に引き出すことのできるスペシャリストを求める動きが活発になっています。 AIも人もいきいきと活躍できる社会を目指す rinna社では、テキストプロンプトを専門に扱うプロンプトエンジニアのポジションを新設し採用活動を進めています。AIの社会実装を推進するにあたり、rinna社はAIに関わる雇用機会の創出も積極的に行ってまいります。

・プロンプトエンジニアの採用情報はこちら

https://www.hireplanner.com/ja/frontend/companies/240/jobs/4444

【rinna株式会社について】

2020年6⽉に設⽴したAIキャラクター開発企業です。「あなたらしい創造力をAIキャラクターと共に引き出し、世界をカラフルに。」をミッションに掲げ、人と人、人と情報、人と社会との繋がりやコミュニケーションの新しいあり方を提案します。任意の人格の口調や学習トピックを反映し、自然な会話をするAIキャラクターを作成できる「Tamashiru」、社内コミュニケーションの透明性を高め、組織の繋がりを強くする「Coordiru」、自分のAIキャラクターを育成し、他のAIキャラクターと交流するSNSアプリ「キャラる」などを提供しています。

このプレスリリースには、メディア関係者向けの情報があります

メディアユーザーログイン既に登録済みの方はこちら

メディアユーザー登録を行うと、企業担当者の連絡先や、イベント・記者会見の情報など様々な特記情報を閲覧できます。※内容はプレスリリースにより異なります。

すべての画像