「AI生成コンテンツも規制すべき」約70% ChatGPT等の台頭以降初の児童ポルノ意識調査で判明

生成AI台頭後初の児童ポルノ規制に関する本格的な世論調査。AI生成コンテンツに関する質問も。

昨今子どもの性搾取の問題が社会問題として取り沙汰されることが増え、AI生成コンテンツによる子どもへのリスクも懸念されるようになってきました。

チャイルド・ファンド・ジャパンは、子どもを暴力や搾取から守るための取り組みを続けており、昨年は、日本政府への署名提出、政策提言も行いました。提言では、現行の児童ポルノの定義を、国際標準となりつつあるCSAM/CSEM(子どもの性的虐待・搾取素材)へ変更することなどを求めました。

昨年Change.orgにて署名活動を行った

こうした活動の一環として、この度、児童ポルノに関する意識調査を実施し、児童虐待防止推進月間である11月にあわせ、その結果を公表しました。類似の調査は内閣府によって行われてきましたが、2018年が最後となっており、今回の意識調査は、特にChatGPT等の生成AIが大きな注目を集めるようになって以降、初の本格的な世論調査となります。

【調査概要】

調査期間 2023年7月30日(日)~8月13日(日)

調査対象 全国の15歳から79歳の男女

回答数 1200名

調査方法 調査員による個別訪問留置調査

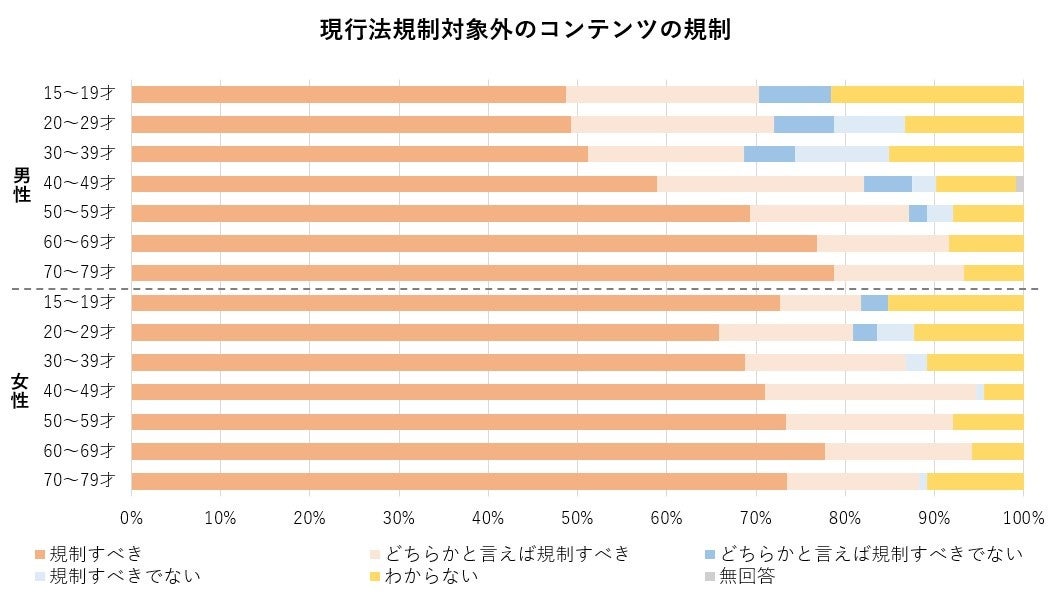

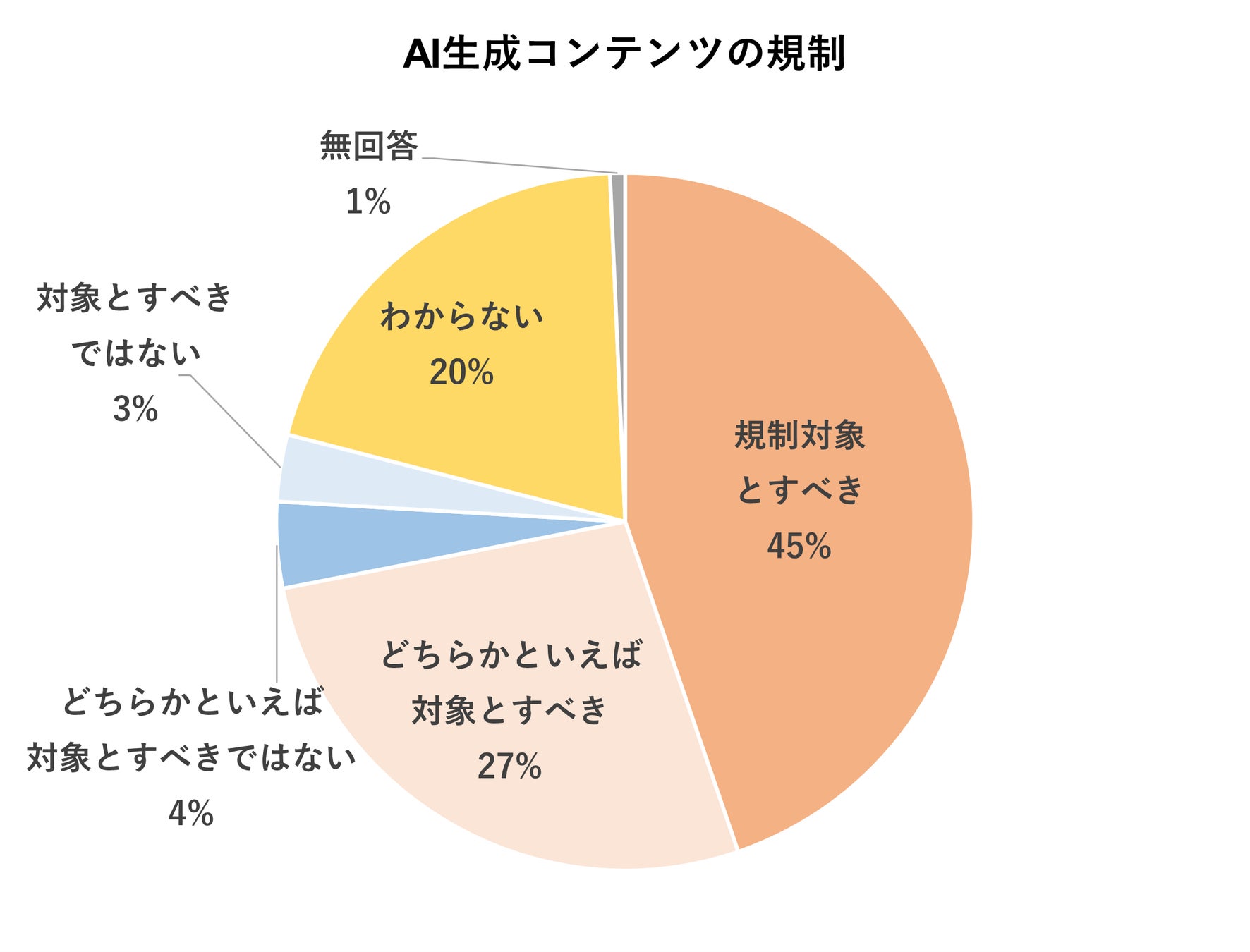

調査では、現行の法令(いわゆる児童ポルノ禁止法)で規制対象となっていない児童の性的表現について質問をし、AIが生成するコンテンツを規制対象とすべきかも問いました。

若年男性の規制支持は相対的に低め。約70%が「AI生成コンテンツも規制対象とすべき」。

調査から明らかになった主な点は以下のとおりです。

児童の性的表現に対する規制を支持する比率は、総じて女性が高く、年齢が上がるほどが高い。一方、若年男性は低めである。

実在しない子どもの空想コンテンツの規制を支持しない理由としては、「表現の自由」が最多。

空想コンテンツ、AI生成コンテンツの規制については、「規制対象とすべき」「どちらかといえば規制対象とすべき」が約70%となる一方、「わからない」も20%ほど見られた。

こうした結果をふまえ、調査チームでは「空想コンテンツ、AI生成コンテンツのリスクについて、メディアなどでの記事掲載を増やすなど、啓発が必要」「映画のレイティングシステムに類似した制度をつくるなど、表現の自由と子どもの権利のバランスをとるためのガイドラインが必要」「こども基本法や子どもの権利条例による施策などを通して、空想コンテンツに対して子どもと若者が「NO」と言える公平でオープンな環境づくりが必要」などを提言としています。

各質問の回答結果、分析、提言、調査票などは、以下で公開しています。

http://www.childfund.or.jp/blog/wp-content/uploads/2023/11/child-pornography-survey.pdf

このプレスリリースには、メディア関係者向けの情報があります

メディアユーザー登録を行うと、企業担当者の連絡先や、イベント・記者会見の情報など様々な特記情報を閲覧できます。※内容はプレスリリースにより異なります。

すべての画像